富士通フォーラム2017が5月18日、19日、東京国際フォーラムで開催されました。

今回はロボットを使った展示が色々とされているとのことで、気になったものをご紹介してきます。

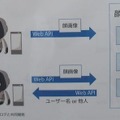

富士通ロボットクラウドプラットフォーム

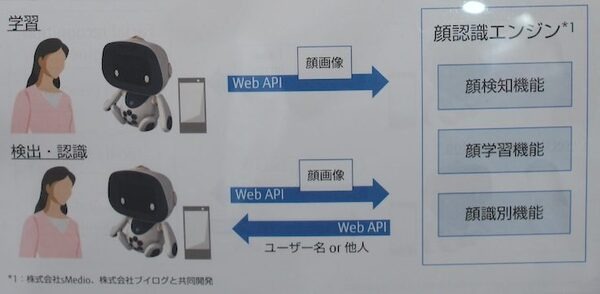

「富士通ロボットクラウドプラットフォーム(仮称)」の展示がされていました。ロボットから人間の顔画像や声を取得し、顔表情認識や音声感情認識の分析結果データを統合管理するというものです。

顔の認識にはDeep Learningを用い解析を行います。

声の解析には音声感情認識エンジンを利用します。音声データのピッチ、トーンなどからその人の気分を喜怒哀楽に分類するというもの。物理的な特徴量から感情を測定します。ピッチやトーンを使って感情認識を行うので、どの言語でも測定可能です。

富士通ロボットクラウドプラットフォームはロボット以外のデバイスでも利用可能ですので、各種デバイスから取得した様々なデータから私たちの日常生活を便利にアシストしてくれるようになるかもしれません。

ロボスタ ユニボ記事一覧

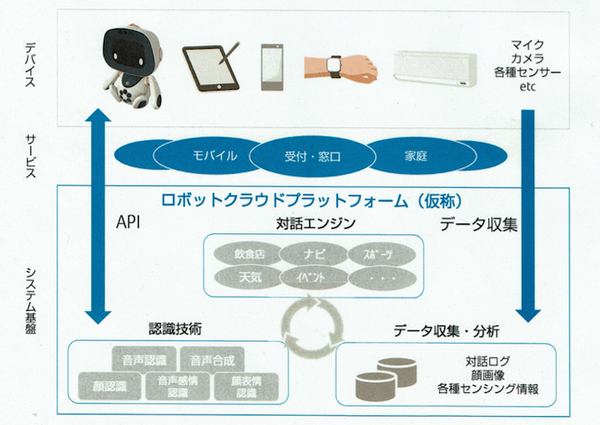

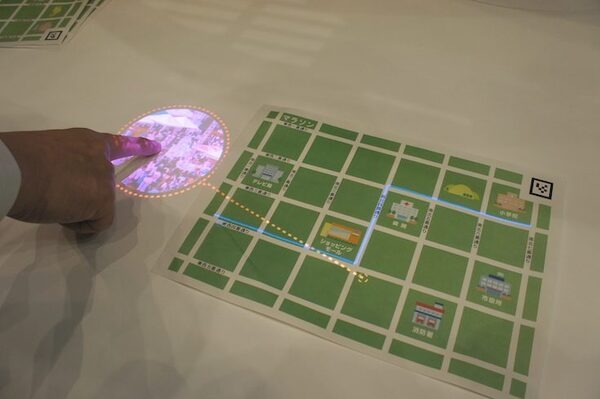

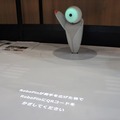

インタラクティブプロジェクション

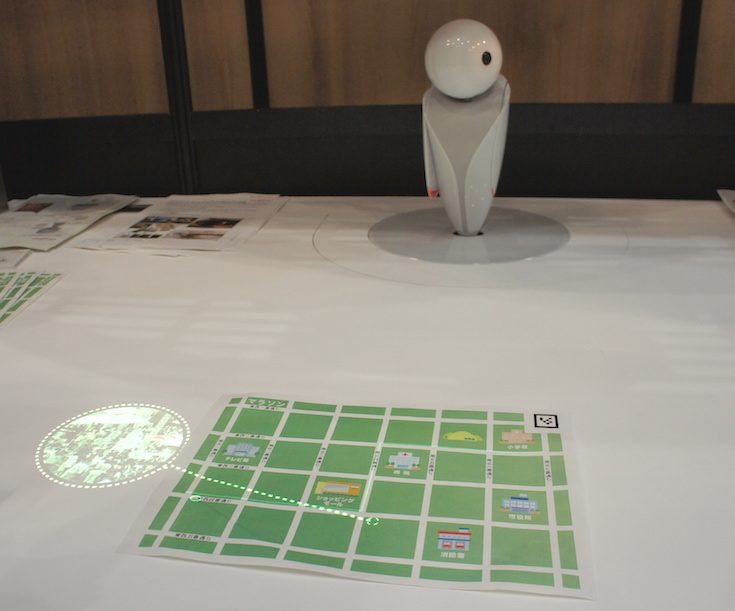

インタラクティブプロジェクションの展示です。こちらは富士通のロボピン(RoboPin)が観光案内をしてくれます。

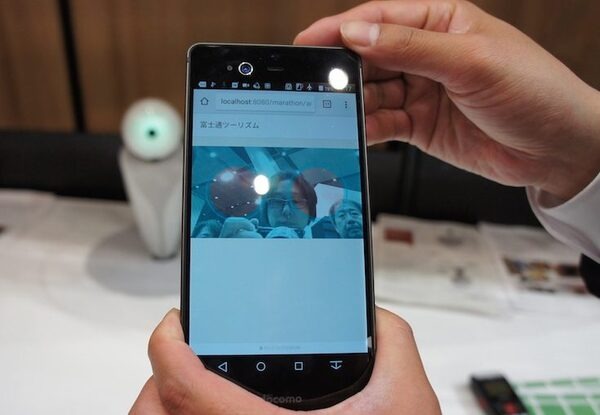

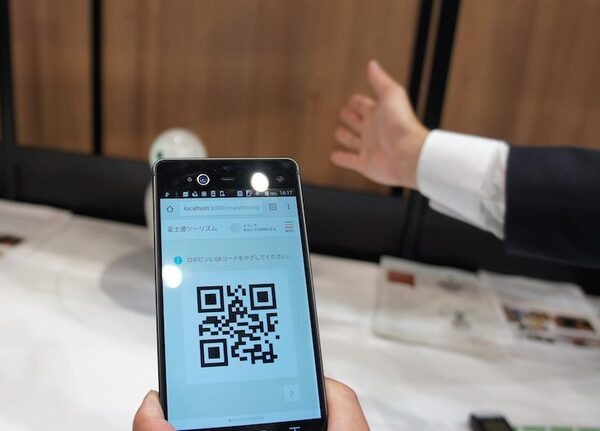

まずはスマートフォンでログインを行います。今回のデモでは、人間の目を使った虹彩認証でログインをしてみます。無事ログイン出来るとQRコードが表示されますので、こちらをロボピンにかざします。

ロボピンが両手を広げた後でロボピンにQRコードをかざしてください」と表示されたので、そのとおりにしてみます。

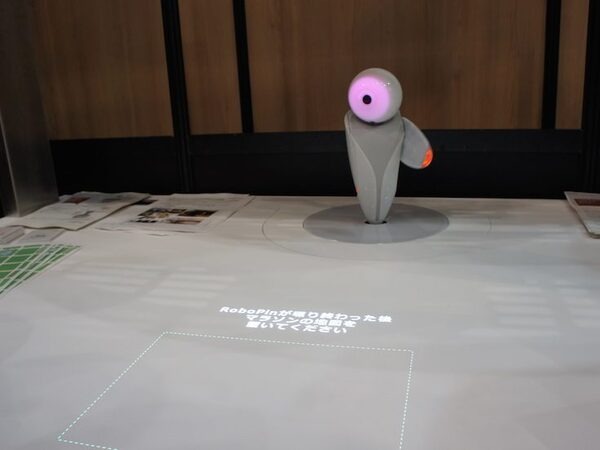

ロボピン経由でQRコードを使った本人認証が完了し、観光案内がスタートします。テーブルに「ロボピンが喋り終わった後マラソンの地図を置いください」とあるので、点線の場所に地図を置いてみましょう。

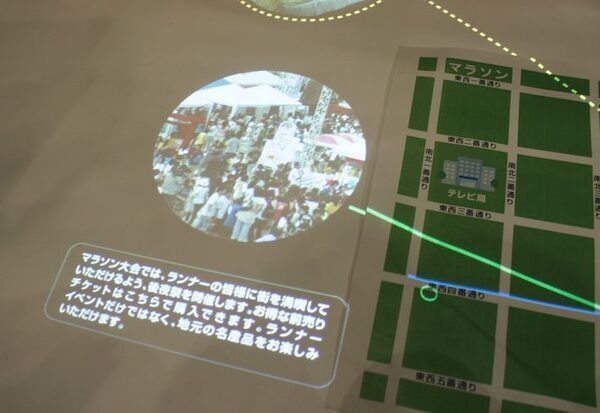

すると地図に画像が投影されたので、その画像を触ってみることにします。

マラソン大会に来た方への観光案内が表示されました。

どうしてテーブルに文字が投影されてその文字を押すと反応するかというと、ロボピンとともにプロジェクター、カメラ、センサもセッティングされており、これらが連携しているからです。

ロボピンとインタラクティブプロジェクション技術を使うと、直感的に様々なことが行なえるので、デジタルが苦手な方でも違和感なくやり取りが行えることでしょう。

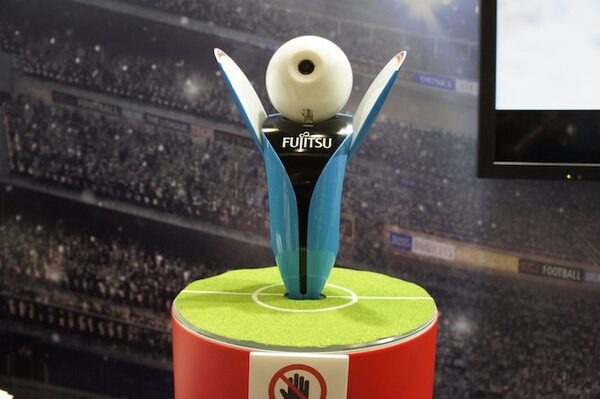

カスタマイズロボピン

会場には川崎フロンターレカラーのロボピンもいました。3M社のフイルムを貼り付けたものだそうです。このようにロボピンは様々なカスタマイズが可能です。

「自社のイメージカラーのロボットが欲しい」という要望も対応することができます。

ロボスタ ロボピン記事一覧

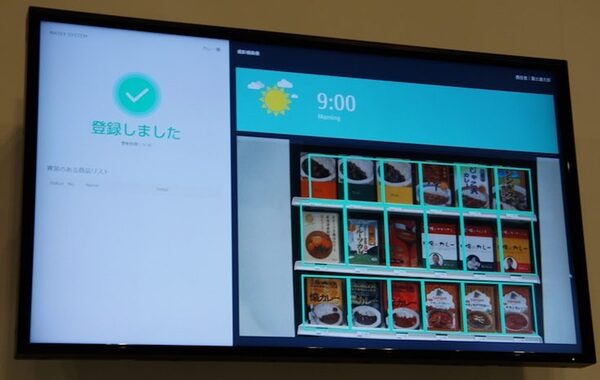

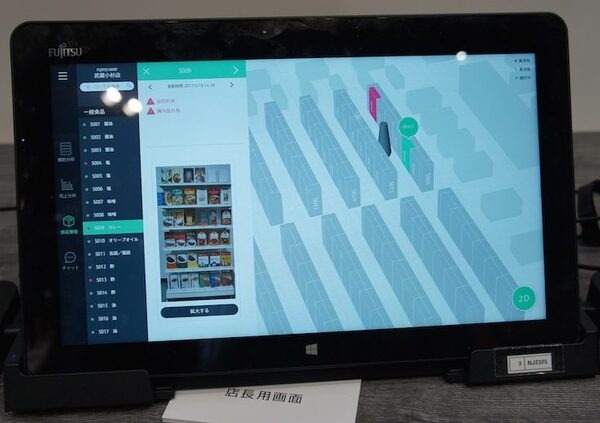

MATEY

こちらは「MATEY」です。

スーパーなどであらかじめ作成した店舗マップをもとに、店舗内を自動巡回します。巡回の際、棚の状況を類似画像検索技術を使って、品切れ商品のお知らせや品出しする商品や順番の提案をしてくれます。

レポートは以上です。

会場では様々な場所でロボピンが使われていたり、ユニボがいたりとロボットを見かけることが多かったです。近いうちに私たちの日常生活でこれらのロボットを見かける日も遠くないかもしれませんね。

富士通フォーラム2017