AI音声アシスタントがユーザーを驚かせる事例がまたネットで話題になっている。

「わはは」アマゾンエコー、突然の笑い声が不気味だと話題に

突然笑い出すAmazon Echo問題、アマゾン公式見解は・・・?

2018年12月21日、ロイターがAmazon Echoによる問題発言を報じた。一体ロイターが報じるほどの問題発言とは何だったのだろうか。

不適切な発話

報道によれば、あるAmazon Echoユーザーが「あなたの里親を殺せ」とAlexaに告げられたという。これは昨年のAmazon Echoのレビューで投稿されたものだ。

他にも不適切な発話の例として、性行為に関するチャットができてしまったり、イヌの糞等に関する下品な発話が確認できたという。

Amazonはこの報道を受けて特定のAlexaの発話については議論を避けたが、不快なコンテンツから顧客を保護するための継続的な取り組みを行っていることを強調した。何百万もの顧客がAlexaと対話している中で、これらの不適切な発話は稀なことだという。実際まれだからこそ、ニュースになっているのだとも言える。

もし発話が不適切だと思ったら・・・

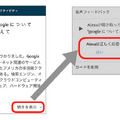

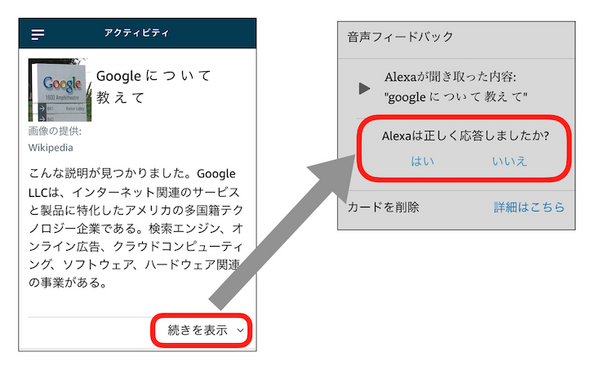

万が一、Amazon Echoを使っていてAlexaの発話を疑問に感じた場合、Amazonに報告しよう。Alexaアプリのアクティビティを開き、対応する音声フィードバックについて「いいえ」を選択、そこから「詳細なフィードバックを送信する」が選択できるので、聞き取りは正しかったとしても、その応答がおかしかったことをレポートできる。きっとAmazonはこれらの指摘を受けてAlexaの発話を改善してくれるはずだ。

Source:Reuters