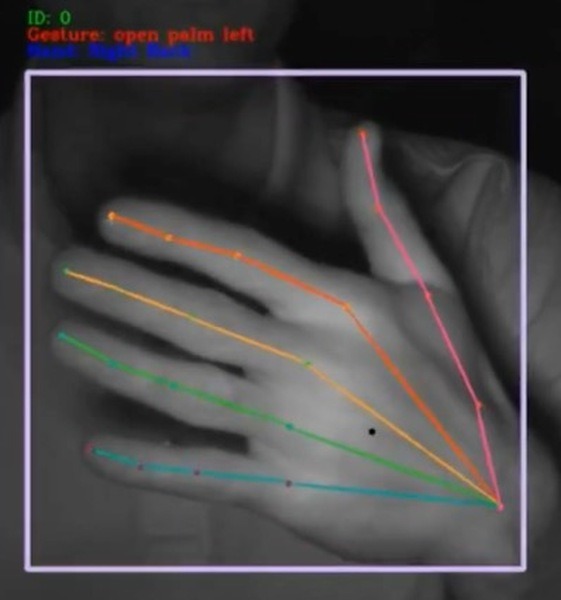

センスシングスジャパン株式会社は2020年8月にカナダのMotion Gesturesが開発した、AIベースのハンドトラッキング及びジェスチャー認識技術『Motion Gestures』を日本市場であらゆるカメラによる用途開発を目的にパートナーシップ契約を締結したことを発表した。(上の画像はYouTubeからキャプチャ)

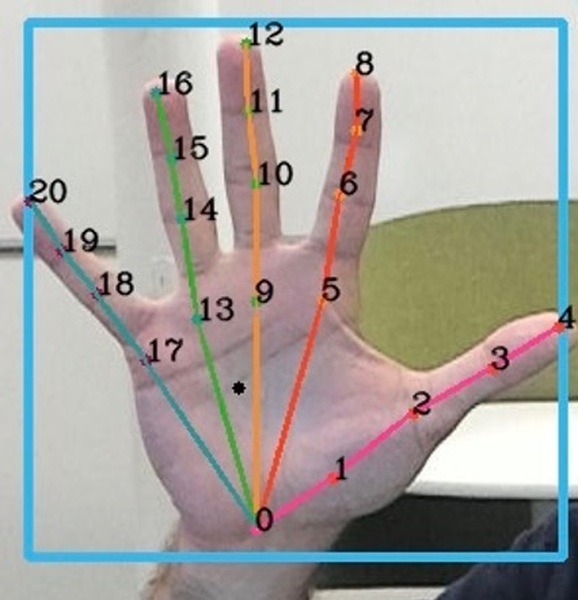

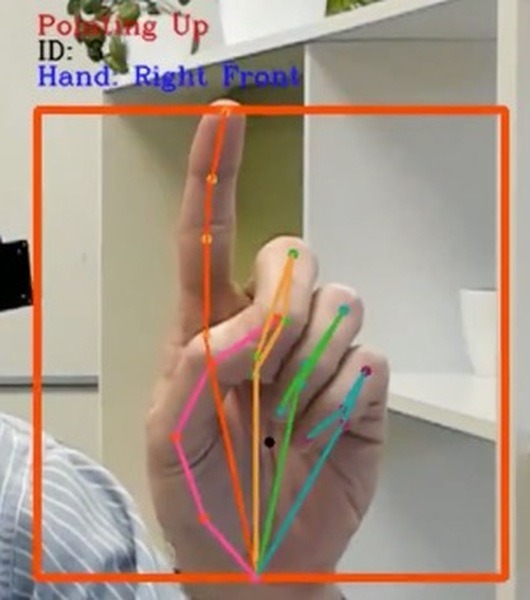

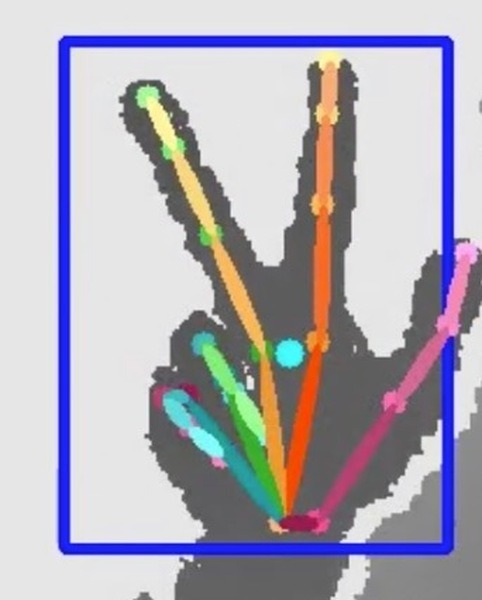

『Motion Gestures』は手の画像をBLOB(Binary Large OBject)として扱う従来のソリューションとは異なり、カメラ映像を通じて21関節をベースとした骨格構造をそれぞれの手に割り付ける。全21関節の位置座標はリアルタイムで測位される。同社は、優位性として次の4つを掲げている。

(1)洗練され且つ正確なハンドトラッキング

(2)100%に近い認識精度で各種ジェスチャー認識に対応

(3)ジェスチャー認識の開発期間と費用を1/10に削減

(4)実物やVRを問わず、所定空間で手の位置を認識可能

■静的、描画、動的の3種のジェスチャーが可能

一般的なカメラだけでもジェスチャーを認識

Motion Gesturesのソフトウェアは一般的な(カラー)RGBカメラだけでなく、近赤外線(NIR)や深度(3D)カメラにも使用できる。また、タップやスワイプ等の複雑なジェスチャーでも深度センサーを使わず、一般的なカメラだけでも認識する。ハードウェアはMPU、CPU、GPUにインストール可能。

センスシングスジャパンは評価用のSDKとAPIライセンスを無償で提供し、自動車、ロボット、エレベーター、キオスク端末、デジタルサイネージ、AR/VR、ゲーム、スマートホーム、電化製品、健康機器など、多種多様な製品の次世代のユーザーインターフェースとしてMotion Gesturesを提案していく。また、現在、社会問題となっている新型コロナウイルスの接触感染に対して、Motion Gesturesは「タッチレス」ユーザーインターフェースとして予防策にも有効と考えている。