自分の外見をAIで置き換えてリアルタイムにコミュニケーションができるアプリ。「xpression camera」を提供する株式会社EmbodyMe(エンボディーミー)が10月26日に「xpression camera Voice2Face(エクスプレッションカメラボイストゥーフェイス)」を中心とする新機能の追加を発表した。

今回の記事では同社が開発した新機能

1.AIで音声を自分の外見に変換する機能

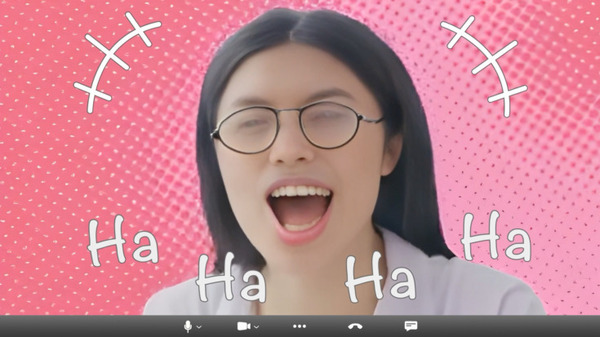

2.LINEスタンプのようにボタンをクリックするだけで豊かな感情表現を演出する機能

を紹介しつつその背景にある思いなどを同社代表の吉田一星氏から聞いた。

xpression cameraとは

xpression cameraの主機能については、以前紹介した際の記事においても触れている。

「自分の外見をAIで置き換えてリアルタイムにコミュニケーションができる」という一言ではわかりにくいかもしれないがビデオを見てもらうとわかりやすいだろう。

世界中で同時に始まったコロナ禍のなかで全員が体験した「Zoom疲れ」の解消が世界的に必要とされている事がわかる。

xpression cameraは、カメラを「表情や体の動きを読み取るためのセンサ」として使い、画像を読み取った表情データに合わせて変形させることができるバーチャルカメラアプリだ。

大まかに言えばいわゆるディープフェイク技術に分類される。

特筆すべきはその処理速度で、吉田氏がいうには同社が開発したAIを使ったシステムは他社にくらべ少なくとも10倍から50倍のスピードを誇るのだという。

この違いは動画の生成に至るまでのプロセスと用途に反映される。

学習プロセス

他社:事前に特定の人物の収録済みの動画データからの表情データの学習が必要。

xpression camera:事前学習が不要。リアルタイムで表情を読み取りが可能。

動画生成プロセス

他社:収録済みの動画に対して表情データを反映する。生成にも動画の長さにより変化するが長時間の計算が必要。

xpression camera:リアルタイムに読み取った表情データに合わせてフレームバイフレームでリアルタイムに生成が可能。

つまり、他社のスピードでは収録済みの画像の改変にしか使用ができないのだ。

解像度にやや不満を覚える方もいるかも知れないが、この手軽さとリアルタイム性がZoomなどのビデオコミュニケーションにも耐えうるものとしてxpression cameraのサービスを特徴づけている。

Zoom疲れ解消と、対面より豊かなコミュニケーションの提供

コロナ禍に端を発した爆発的なオンラインコミュニケーションの普及。それは様々な恩恵をもたらすと同時にSFでも予見できていなかった問題点も明らかにした。

どこででも仕事ができる自由を得たはずなのに、なぜか異常に疲れる方も多いだろう。

その原因として挙げられるのは

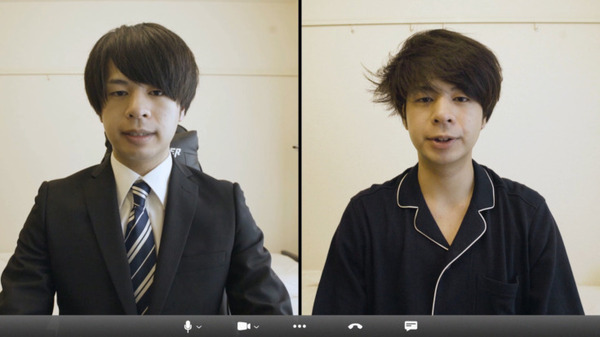

1「自室の中が覗かれているような気がする」プライバシー的不自由

2「外見が気になる、いつも見られている気がする」ルッキズム的不自由

3「カメラの前から動けず視線を外せない」行動、姿勢の不自由

などの理由だ。

ビデオをオフにしてしまえば済む、といわれても、表情が伝わえる非言語情報はかなりのものなので、十分なコミュニケーションのためにはビデオをオフにはしづらい、という方も多いのではないだろうか。

そこでxpression camera ではそれぞれの課題について下記のようなアプローチで解決していった。

「1.プライバシー的不自由」に関しては多くのビデオ会議システムが「バーチャル背景機能」を搭載することで対策がなされている。

しかし、ふとした動きで背景が見えてしまった経験がある方は多いだろう。

そこで、1の解決策を万全にし、さらに「2.ルッキズム的不自由」の問題も解決したのがカメラのモーションセンサ化だ。

カメラ機能の用途を「画像を送信する」ことから「モーションセンサ」へと変換し、送るべき情報を「画像」ではなく、「体の動きと表情」に制限した。

それらの情報をもとに写真をモーフィングすることで「情報は伝えるが状況は伝えない」というサービスを実現したわけだ。

また、セルフビューが表示されている事が多いビデオ会議システムでは否応なく自分の姿かたちを意識してしまう。また、他者からの外見による評価などが気になるユーザーも多いだろう。

写真一枚からオリジナルアバターを作れる、とも言いかえられるxpression cameraでは写真を変更するだけでそういったルッキズム的な問題をすべてクリアすることもできる。

しかし、これで万事解決かと思われたが、まだ「3.行動、姿勢の不自由の問題」があった。そこを解消するのが今回追加された機能だ。

限定された画角の中に顔を収め、無用な誤解を生まないよう常に画面を見続けなくてはいけないというビデオ会議ならではの姿勢は長時間続けると肉体的にかなりこたえる。

また、在宅勤務ならではの問題として「家にいるならば、こなさなければいけない家事」などがある。

育児をしている在宅勤務者などは、「会議中に子供が乱入してくる」といったシチュエーションを容易に想像できるだろう。

そういった問題をクリアするために実装されたのが「声から自動的に表情データを生成する」xpression camera Voice2Face機能、というわけだ。

これにより、「場所的な制約」から解き放たれたものの「行動の制約」という思ったよりも厳しい条件があったビデオ会議に、さらなる自由がもたらされた、といえるだろう。

さらに、今回実装されたクリックひとつで劇的な表情アニメーションを画像に付加する機能。これがあれば、素の自分ではできないようなリアクションもできるようになる。

日本人の表情変化は思った以上に小さい。それだけにちょっとした動作一つで感情を深読みされた経験がある方も多いのではないだろうか。。

xpression cameraの新機能を使えば、こういった不安を感じることなく伝えたい感情をクリックひとつで相手に届けることができる。

これがxpression cameraの提供する「オンラインコミュニケーションの不自由さの解消」と、「対面よりも豊かな表現」というわけだ。

リラックスした状態で相手を楽しませるような表現を使いながらコミュニケーションできる未来に一歩近づいた気がするのではないだろうか。

気になるモバイル対応は

ここまで行くと気になってくるのはモバイル対応だ。

家で家事をしながら仕事をすることができるのなら、散歩をしながら仕事をしたっていいじゃない。と思ってしまうのが人情だろう。

吉田氏いわくAIチップや顔認識機能が標準搭載されたスマートフォンはマシンスペック的に十分xpression cameraを実行可能だという。

しかし、PCではバーチャルカメラとしてxpression cameraを認識させれば、様々なアプリ上で機能させることができるのに対し、スマートフォンでは、「Zoom専用xpression camera」のような形で各アプリケーションごとに機能を作り込んでいかなければいけないため、現状では対応が難しいのだという。

個別のB2Bサービスなどに対してAPIを提供するなどの形を予定しているとのことなので、もしかすると、読者の会社の社内ツールが突如音声だけで表情が作れるようになるかもしれない。

EmbodyMeの見る未来とは

現在、Plateauによる3D地形マップや、UNITYやBlendarなどで作られた部屋の3Dデータ、いわゆるお絵かきAIによる人物データやバーチャルヒューマンなど、さまざまなデータを入手できる環境にある。

それに加えて実際の町並みや施設、人物がデジタルツインを目的にスキャンされている。

この流れはおそらく今後加速していくだろう。

そしてEmbodyMeが機能拡張をしていけばそれらのデータはすべてバーチャル背景や、人物データの選択肢に入ってくるだろう。

その流れの中で最先端を走る吉田氏はどのような未来を予想し、プロダクトの進化させていくのかを聞いてみた。

究極の目標は「誰もがAIで目に見えるあらゆるものを自由自在に作り出す世界を作る」ことなのだという。

そのなかで具体的な未来のイメージを2つ挙げてみよう。

たとえば、『俳優や風景など、具体的な何かを取り込むための行為「撮影」というプロセスを経ずに、誰もが「思い描いた世界観やストーリー」を映像として作ることができる未来』

「コミュニケーション」を『相手に自分の考えを伝える』ことだと捉えれば、自分の頭の中のイメージを相手にとって理解しやすい映像にするほうが、言葉を尽くして説明するよりも遥かに伝わりやすいだろう。

そのためのツールとしてのxpression cameraという形がありうるわけだ。

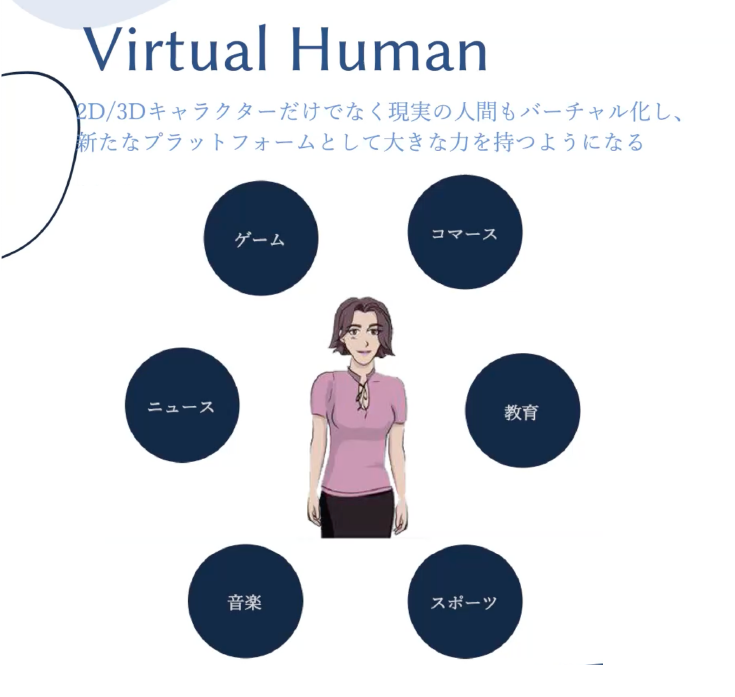

たとえば『キャラクターだけでなく現実の人間すらバーチャルヒューマンとしてIP化され、能力や時間や空間などの制約から解き放たれた情報発信プラットフォームになる未来』

制約から解き放たれたバーチャルヒューマンの具体例は様々なスポーツに挑戦し、宇宙旅行までした「ガチャピンチャレンジ」だろう。外見によってキャラクターが確立していれば、中身はそれぞれの分野のスペシャリストが受け持つだけでコンテンツとして成り立つ。

現在ではSNSなどのプラットフォームを通してインフルエンサーがライブコマースやニュース、エンターテイメントなどを発信しているが、そうした未来においては上記のようなキャラクターが情報発信のプラットフォーム化してくるだろう吉田氏は予想する。

この流れに伴って「アイデンティティとは」「情報の信頼性とは」といった様々な問題が生まれることは予想されるが、そういったものは技術によって変化し続ける人間観や哲学とすり合わせながら解決していくしかない。

オンラインコミュニケーションによる課題解決からxpression cameraが生まれたように、こうした課題からさらに面白いサービス、プロダクトが生まれていくことを期待したい。

xpression camera