オンラインのセキュリティ対策製品を提供しているマカフィーは、開催中の大規模国際スポーツ大会といった注目が集まる機会に乗じた詐欺が増加していることを明らかにした。詐欺師らは熱気を帯びるイベントを利用し、偽のチケットから模倣品の販売まで、警戒心が緩んでいるファンに悪質な詐欺を働くとしている。

このような詐欺には、人間の感情を利用して、重要な情報を侵害する手法「高度なソーシャルエンジニアリング技術」が使われ、AIの進歩でこれまで以上に巧妙な詐欺が身近なものになっているという。

音声クローニング技術を使うと、詐欺師は説得力のある偽の音声メッセージを低コストで作成することができる。2023年にマカフィーが発表したAI音声詐欺の調査ではそれが明らかな結果が出ており、高度な複製技術が詐欺師の手に渡った際の脅威が増していると警告している。

イーロン・マスク氏の声でフェイク情報を拡散

直近では、大規模国際スポーツ大会に絡めたとある動画で、著名な起業家であるイーロン・マスク氏の声でナレーションされた架空のディープフェイク版のシリーズがストリーミングサービスで配信されて注目を集めている。

該当の動画は、詐欺師が著名人を利用して信憑性のあるストーリーを作り出してフェイク情報を拡散、さまざまな手段を使って人々を欺こうとしているかを知ることができる。

国際的なイベントの開催タイミングに合わせて詐欺を働くケースが多いので、特に規制が緩いプラットフォームでみられるセンセーショナルな主張が真実かどうか問い続けることが重要だとしており、巧妙な詐欺に騙されないように、常に公式チャンネルを通じて情報を確認することを推奨する、とマカフィーは述べている。

このようなフェイク動画を制作したクリエーターは、人気のあるストリーミングサービスの作品であることを主張するだけではなく、信頼できる出版社からの捏造された支持のコメントやレビュー画像も広め、人々の心情をあおる詐欺を仕掛けてくる。

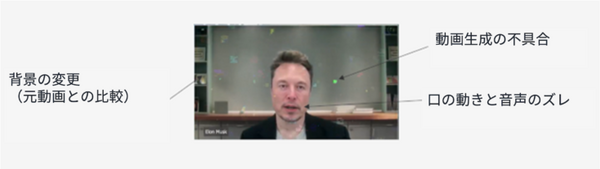

フェイク動画を注意深く見ると特定の不具合や違和感が

フェイク動画の主な手法としては、AI音声クローニング、画像拡散、リップシンク(画面の唇の動きと発せられる音声が連動している状態)などがある。動画がまるで本物のシリーズ作品に見えるように、巧妙に作られている。しかし、動画の中には画像を重ねて使用しているシーンが多くあり、注意深く見ると特定の不具合や違和感が確認でき、作られたものだとわかる。

シリーズ内の動画で見られる不具合や不一致

元の素材は、ウォール・ストリート・ジャーナル(WSJ)のインタビュー動画が使用されており、その上から修正が加えられている(背景に注目)。しかし音声クローンについては人間の耳ではほとんど区別ができないレベルに達しているという。

元の動画:メディアのインタビュー場面を切り取り

イーロン・マスク氏の声は以前から模倣の対象となっていた。マカフィーが発表した2023年ハッカーセレブリティホットリスト(英語のみ)では6位にランクインし、暗号通貨詐欺で最も頻繁に模倣される著名人の一人でもある。

ディープフェイクの音声検出技術を開発

マカフィーは、ディープフェイクや関連する詐欺の蔓延が情報操作やデマキャンペーンとともに増加の一途をたどる中、ディープフェイクの音声検出技術を開発。2024年5月の「RSAカンファレンス2024」でIntelのAI PCに搭載された「McAfee Deepfake Detector(旧称「プロジェクト・モッキングバード(Project Mockingbird)」は、人々が虚構と真実を見分けるのを助け、AIが生成した捏造音声を利用して、金銭や個人情報の収奪、ネットいじめ、著名人の公共イメージを操作する詐欺を行うサイバー犯罪者から消費者を守るとしている。

国際イベントの開催に合わせてAIツールを利用した詐欺が急増するため、自宅で応援するとしても、警戒心を持つことが重要である。過度な特典をうたったテキストメッセージには注意した方が良い。また、見知らぬウェブサイトを避け、さまざまなソーシャルプラットフォームで共有される情報に対しては懐疑的であることも必須となっている。そして、常にこの情報は本物なのか、という目で吟味し、その情報を利用したり、拡散する際には注意するコトが重要だ。また、オンラインでの安全性を高めるツールの使用も推奨されるという。

オンラインでコンテンツを閲覧する際の注意すべき事項

AIコンテンツは現在、ますます信頼性が高まっているため、マカフィーはオンラインでコンテンツを閲覧する際の注意すべき事項を挙げている。

1:信頼できないソース(情報元)からのコンテンツには懐疑的になる

常に疑いの目を持って確認する。信頼に欠ける情報元の場合、コンテンツは規制が緩いプラットフォームのみでアクセス可能で、一般的ではないパブリッククラウドストレージに投稿されている。

2:コンテンツを閲覧する際には警戒心を持つ

ほとんどのAIによる捏造は何らかの欠陥を持っているが、一目見ただけではそのような不一致を見つけることはますます難しくなっている。動画内で偽造されたと思われる明らかな指標を上記でいくつか指摘しましたが、音声はさらに複雑である。

3:情報をクロス検証する

コンテンツのクロス検証については、検索エンジンでタイトルに基づいて行うか、人気のストリーミングサービスのコンテンツを検索することで、おかしな点に気づくことができる。

マカフィーは、AIが生成したコンテンツを識別するツールを提供し、必要に応じてその適用に関する認識を高めることで、消費者が十分な情報を得た上で意思決定できるよう支援するとしている。

東大発のベンチャーNABLAS AIが生成したかどうかを判定したり、文章の真偽を確認する「フェイク検出器」 電子透かし情報の確認機能を追加

AOSデータ、フェイクデータ解析と証拠調査を行う「ディープフェイクフォレンジック」取組を開始 調査の手順と特定するしくみ

マカフィー株式会社