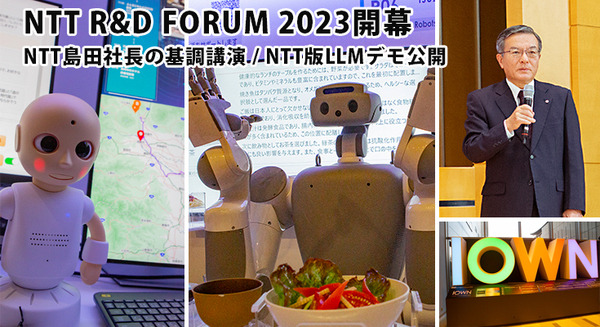

2016年2月18日、19日にNTT武蔵野研究開発センタで開催された「NTT R&Dフォーラム2016」に行ってきました。

NTT R&Dフォーラム2016

https://labevent.ecl.ntt.co.jp/forum2016/info/

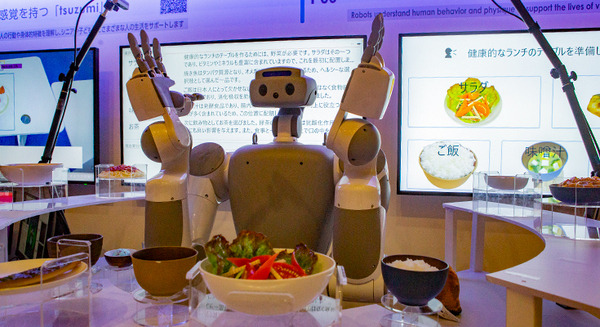

その中でもサービスロボットに関連しそうな展示を何回かに分けて紹介します。

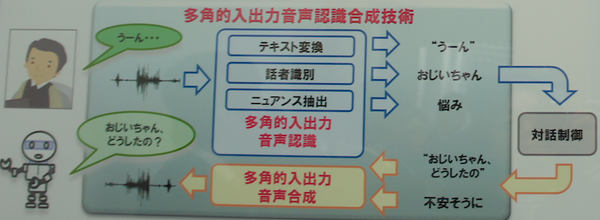

■「自動応対エージェント向け多角的入出力音声認識合成技術」とは

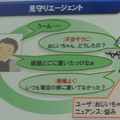

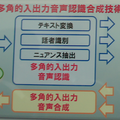

人間の音声を聞いて音声をテキストで認識するだけではなく、感情や意図やニュアンスまでを認識するという技術です。

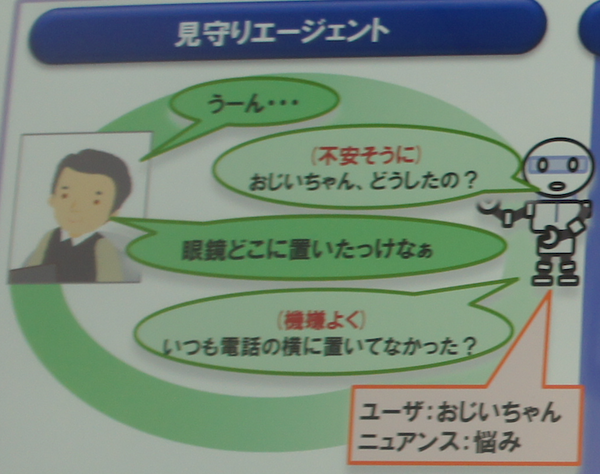

例えば「うーん…」という声だけを聞いた時、通常ではテキストデータとして「うーん」とだけ認識しますが、この技術を使うと「(不安そうな)うーん」という認識が可能です。

悩んでいるかどうかなどの感情や意図に該当するニュアンスを音声から抽出するというものです。

他にも、ディープラーニング技術を使い、自然な話し言葉を高速に高精度でテキスト化をしたり、少人数の中から誰が話しているかを音声から判別することも可能です。

■音声合成がさらにすごい

人間の声を聞いてニュアンスを抽出するだけではなく、そのニュアンスを受けて感情を込めた合成音声の生成も可能です。

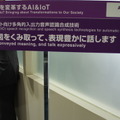

先ほどの例で「うーん…」という声だけを聞いた時、この技術を使うと「(不安そうな)うーん」という認識が可能と説明しましたが、この(不安そうな)を受けて、合成音声に「おじいちゃんどうしたの?」と発話させることが可能です。

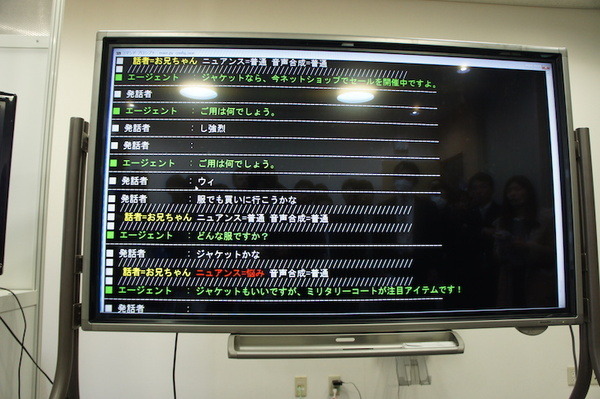

■実演のデモを見てみましょう

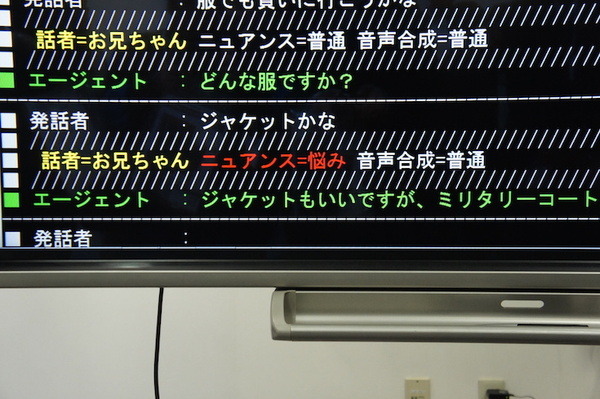

人間(発話者)がマイクに向かって「服でも買いにいこうかな」とはなしかけます。すると、「ニュアンス=普通」という認識をします。

続いて「ジャケットかな」としゃべりかけると、「ニュアンス=悩み」と表示され、人間の声から本人の感情も認識します。

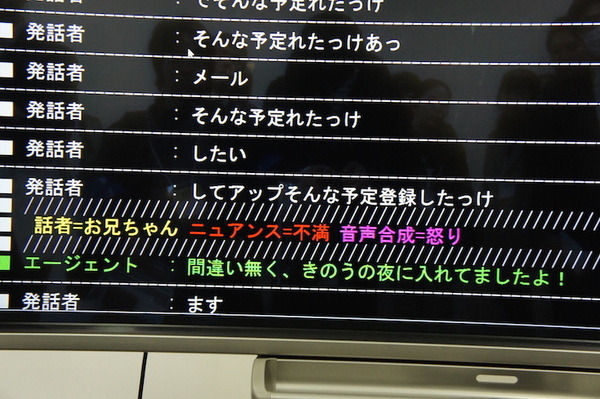

次のデモです。

人間(発話者)が「そんな予定登録したっけ」とはなしかけます。この音声を「ニュアンス=不満」と認識をして、自動応答が怒りの感情を込めた「間違いなく、きのうの夜に入れてましたよ!」と発話をしました。

もはや自動応答ながら、人間と会話しているのと変わらないやりとりです。

この技術がコミュニケーションロボットに入ったら、今まで以上に人間に寄り添った話し相手となるかもしれませんね。

今後の展開が楽しみです。