2019年9月26日、日本ロボット学会主催のセミナー「ロボット工学の未解決問題 ~ロボットへの期待とその障壁」が行われた。四人の講演者による課題が挙げられた。レポートする。

・ロボットのための環境知能化・構造化

・ディープラーニングとロボット工学の融合、知能の構造、科学の未来

・ヒューマノイドの未解決問題 現実世界の拘束条件を利用して機能を水平分割

・MUJINによる産業用ロボット知能化

ロボットのための環境知能化・構造化

当初、最初の講演者はカーネギーメロン大学の金出武雄氏の予定だったが、当日体調不良とのことで、急遽、東大の淺間一氏が講演した。淺間氏は金出教授の「素人発想玄人実装(実行)」、「Newness is not virtue, but usefulness is.(新規性にこだわりすぎてイノベーションが起きにくくなっている)」、「人はBitを食べて生きていけない(バーチャルだけが進みすぎて物理が過小評価されている)」、「PMはGoalにCommitする。PIはMethodにCommitする(プロジェクトマネジメントとPIを分離しないといけない)」といった「金出語録」を紹介した。

そしてロボット産業の将来市場予測を示し、伸びが期待されているサービス分野にもパーソナルサービスとパブリックサービスがあり、政府の「ロボット革命実現会議」、そして「ロボット新戦略」などの取り組みの現状を紹介した。技術だけではなく、広い意味での環境の充実が重要だと述べ、「RT(ロボットテクノロジー)」の概念を紹介し、「ロボット技術」はセンサ、知能・制御系、駆動系の技術要素を持つ知能化した「機械システム」として捉えるべきだと強調した。「ミッションに対してソリューションを与え、システム化」することが重要だという。単なる要素ではなく、機能を実現するために要素を統合することがロボット技術の真骨頂だが、なかなか理解されづらいと述べた。

ロボットを動きやすくするための環境知能化・構造化もそのなかに含まれ、環境自身も含めて設計することが重要だとし、これまでの淺間教授の研究コンセプトを紹介した。また、自動化、無人化、自律化はそれぞれ意味が違うという。自動化は環境に何らかの操作を施して機械を動作させること。無人化は遠隔操作なども含む。そして自律化は環境が限定されず、自ら行動を生成して動ける技術だ。移動ロボットもそれぞれ違う枠組みで捉えることができる。軌道上の移動のように環境要因が限定されている場合は、自律性はあまり必要ない。いま高精度な自己位置同定システムが衛星やAIを活用して利用できるようになってきたが、現状のロボットはまだ無限定の環境では動くことができない。それが今後求められる研究テーマであることは間違いない。

経団連の「産業競争力懇談会」では「人共存ロボティクス」に関する国への提言作りにも力を入れている。ユーザーである人とロボットが直接インタラクションするためのロボット技術である。そこにはユーザーとの共存、また第3者との共存のための情報技術・安全技術が必要になる。そのためには人を知り、行動や意図を理解・推定するための技術も重要だ。いっぽう、人手不足を背景とした省人化ニーズも高い。ただ、経済的視点だけではなく、新たな価値創出や人道的視点も極めて重要だと述べた。

人共存ロボットにおいては安全・安心が重要になる。淺間氏は「ALARP(As Low As Reasonably Practicable)」という考え方を紹介した。一言でいえば合理的かつ実行可能な限りリスクは低減すべきだという意味で、達成できないと許容されない基準値と、十分に安全だと考えられる基準値を設定し、そのあいだのリスクは総合的に判断して対応するという考え方だ。

そして科研費「移動知」の研究を紹介した。動物が持つ環境に応じて適切に行動できる知的能力である「適応的行動メカニズム」を科学的に解明しようという研究だ。身体が動くと、環境と身体の間に物理的インタラクションが生じる。その情報は身体を通じて脳に入ってくる。そして適応的行動が生まれる。そのメカニズムを解明することができれば、適応的に行動できるロボットも実現できるというわけだ。まずは行動があると考えるところが従来の考え方とは異なっているところだ。この研究を応用して起立支援システムなどの開発も行っている。

淺間氏はこのほか、福島第一原発廃炉に関するロボット導入や、遠隔操作において重要な機械による介入の話題などを紹介した。

ディープラーニングとロボット工学の融合、知能の構造、科学の未来

東京大学大学院 工学系研究科教授の松尾豊氏は「深層学習とロボット工学の融合の可能性」と題して講演した。松尾氏ははじめに「AlphaZero」などの事例を紹介。「AlphaZero」は、将棋の序盤で王将を中段に動かすなど、今までの理論の枠組みとは違う戦略を取る。これは人間の思考の癖にとらわれない良い戦略を機械学習技術が見出し得ることを示しているという。また、アミノ酸配列からタンパク質の三次元構造を推定することができる「AlphaFold」のような応用も出てきている。

ディープラーニング革命によって、認識から身体性や運動の習熟を経て、言語の意味理解へと進むというのが松尾氏の考える機械学習の発展だ。アプリケーションとしては防犯や自動運転を経て、家事や介護、そして本当の意味での言語処理を経て翻訳やホワイトカラー支援へと進むという予測を2014年に出しており、いまのところ、だいたい予想どおりだという。

2012年以降、画像認識技術の応用は2015年くらいから始まり、いま実用化製品がどんどん出てきている、ワシントン大学による物体検出の「Yolo」などが知られている。

運動の習熟は深層強化学習技術を使って研究が進められている。これも2015年ごろから出始めて、いま多くの研究が進められている。松尾氏はUCバークレーの「BRETT」や、グーグルの分散学習、OpenAIによるロボットハンドの研究例を示した。また、松尾研究室発ベンチャーの一つであるDeepXはフジタとの共同研究で、画像認識を使った建機の自動制御に取り組んでいる。

■動画

自然言語処理については2018年に登場した「BERT」による機械翻訳や、Googleトランスレートがトピックスだった。いまでもすごい勢いで進化しているという。

松尾氏はディープラーニングは一言でいうと「深い関数を使った最小二乗法」だと述べた。ざっくり言ってしまうと変数が桁違いに多い最小二乗法で、ただし、入力と出力が直接繋がっているのではなく中間の関数が2層、3層となっていることで表現力が豊富になっているのがディープラーニングだと説明しているという。深い関数が使えるようになった理由は計算機のパワーが上がってきたからだ。ただし、ディープラーニングはデータが多いと言われるが、実はパラメータの数に比べるとデータ量は少なくていい。そこがディープラーニングの本当に面白いところだという。

そして、翻訳のようなタスクの場合はRNN(再帰型ニューラルネットワーク)を使うことが多いが、RNNを「Transformer」に置き換える方法が面白いと紹介した。「Transformer」とはマルチヘッドのセルフアテンション機構をN段重ねるというもの。アテンション(注意)とは隠れ層への特定の注目を実現する機構だが、そのベクトルには別のニューラルネットワークの隠れ層の情報を使う。ここで「セルフ」というのはネットワークが自分がどこを見るのか決めることができるという意味だ。つまりアテンションの機構を複数持ち、N段繰り返したアーキテクチャになっている。すると言語理解タスクの精度が上がるというもので、「面白いけど、なぜうまくいくのかよくわからない」と言われていたのだという。

これはもともとヒントン氏らが提案していた「カプセルネットワーク」に近いと考えられているという。カプセルネットワークとはニューラルネットワークの一つの一つのユニットが、あるスカラー値だけを持つのではなくベクトルも持つべきだという考え方を基本としたもので、脳の「コラム構造」のようなものをモデル化するすることを志向している。特に重要な点は、下位のレイヤーのニューロンが、次のレイヤーのニューロンのどこに情報を送るかコントロールできるところにある。Transformerのセルフアテンションは、これとは逆方向だが、原理的には近い。あるレイヤーのニューロンが次のレイヤーのどこに送るか指定している、つまり情報の流れを決める機構を持っているからだ。この情報をどこに送るかという機構自体が重要なのではないかという。

また、Palm創業者のジェフ・ホーキンスがかつて言ったように予測が重要だと述べた。自動運転のように実世界で動くためには「自分が行動するとこうなる」とわかっていて、フィードフォワードで制御して動かないと、うまく動けない。

DeepMindから発表された「GQN(Generative Query Network)」という手法も面白いという。三次元的空間再構成ができる手法だ。人は、空間のなかで、どこの位置に立つとどう見えるか、予測ができる。だがそういう技術はまだない。また、人間の場合はこの世界が3次元であると教わってないにもかかわらず、視覚や聴覚センサーからの時系列入力の結果、世界が3次元構造だということに気づいて世界モデルを作っている。

■動画

GQNは、ある視点からみるとこういう見え方で、こっちからだとこう見える、ではここから見るとどう見えるかといった問題を解かせるだけで3次元空間の世界を学習できるという手法で、しかも3次元を仮定せずに3次元的な世界の再構成ができるところがすごい。たとえば人の動作をもとに何かを伝えるには、コツをうまく伝える必要がある。コツとはセンサー-アクチュエーターの操作時系列を低次元にした構造を見つけ出すことだと考えられるが、それもまたGQNのような技術を進めていけばできるはずであり、ワールドモデルの研究は重要だと強調した。

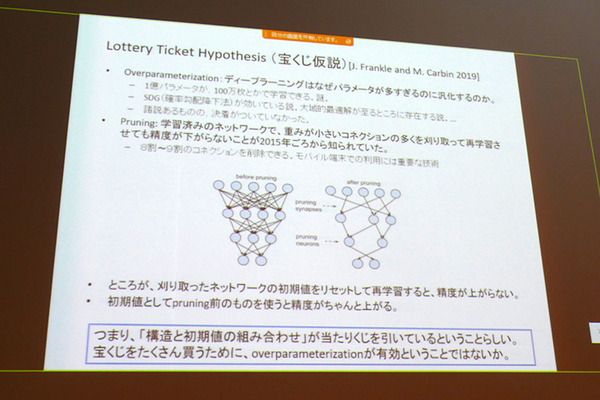

なぜパラメータが多すぎるのに汎化できるのかという問題については「宝くじ仮説」というものがあると紹介した。一般的にはフラットな局所解のほうが汎化性能が高いから汎化するんだという説が有力だが、「宝くじ仮説」はそれとは異なっている。学習済みネットワークで重みが小さいコネクションの多くを刈り取って再学習させても精度がそれほど下がらない「プルーニング」と呼ばれるやり方が、軽量化が重視される実装では用いられることが多い。プルーニングがなぜうまくいくのかについて研究が行われた結果、ネットワークの構造と初期値の組合せが重要であり、その当たりくじをひくかどうかが重要なのではないかと言われはじめているという。

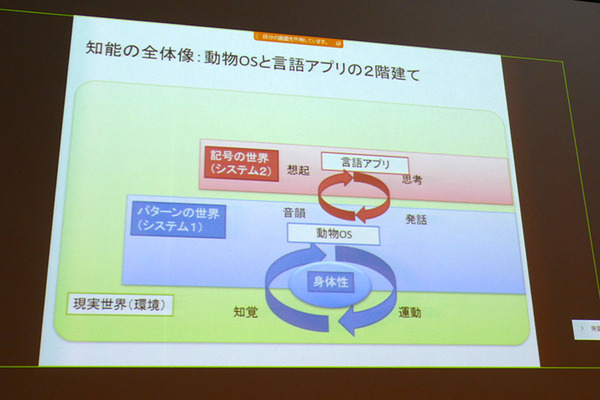

人工知能の世界は記号派とパターン派が戦ってきたが、どちらも正しいと述べた。松尾氏は、人間の知能は身体性にもとづく「動物OS」が、記号の世界である「言語アプリ」を駆動するような構造になっていると考えているという。たとえば「大きなリンゴの木がある」という言葉を聞くと、我々は大きなリンゴの木を実際に見ていなくても脳のなかにその姿を描き、シミュレートする。これがつまり、言語アプリが動物OSを呼び出してシミュレータとして使っているということであり、また言語に戻しているということを示しているという。

単にいま見えているものだけを相手にするのではなく、「今ここ」では見えてないものを想像して、模擬的なセンサー入力とするのは人間しかやらない。これはある意味では非常に危険だからだ。実際のセンサ入力と自分が脳のなかで作り出した情報を混ぜるのは、幻想や幻覚をうむ可能性がある。だが人間の場合は、虚構を信じることがたまたま集団としての生存確率を上げるので、そういう特異なことをやるようになったのではないかと松尾氏は述べた。

そして言語アプリが主体となる記号操作系を知能の根源だと考えており、知能は「二階建て構造」をしていると強調した。ソシュールのいうシニフィエシニフィアン/シニフィエはそれぞれ動物OSが言語アプリへのコマンドと考えられ、呼び出し命令のことをシニフィアン、実行内容をシニフィエといっているのではないかと考えられるという。また二階建て構造になっていることで学習速度の向上にも貢献しているのではないかと述べた。

チューリングテストと、ジョン・サールの「中国語の部屋」についても言及した。松尾氏の言い方では「理解する」とは言語アプリが動物OSを呼び出すということだ。だからサールが言っていることが正しいと考えられるという。意味は通らないが文法的に正しい文章が存在できる理由とは、APIで呼び出したときにnullが帰ってくるようなもので、言語アプリが動物OSを呼び出していると考えればうまく説明できるという。

いまはまだ「動物OS」の部分がないが、画像認識やロボティクスの分野でそれができ、さらにそれが記号系と結びつくと、本当の意味での言葉理解ができるようになるはずだと述べ、それは近い将来、五年、十年くらいでできるようになるのではないかと語った。コンピューターがメールの理解や言葉がわかるようになるというわけだ。

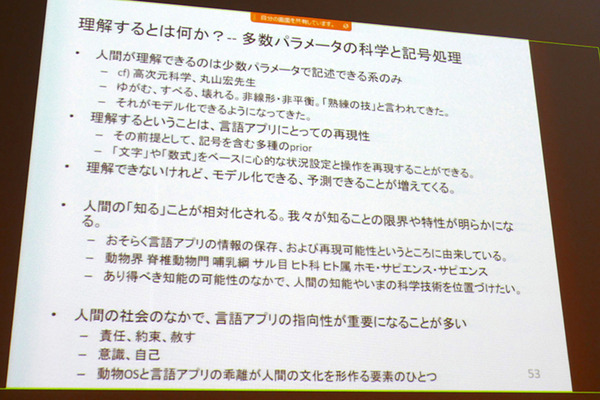

また、多数パラメーターの科学、高次元科学の時代が来るとも述べた。そして人間が「理解する」ということそのもののメタ理解ができるのではないかという。現在の我々がいう「理解する」というのは「理解とは言語アプリにとっての再現可能性のこと」だという。動物OSにおける世界のモデル化は「理解」とは言っていない。たとえば自転車の乗り方は言語化はできていないが動物OS部分でじゅうぶんこなすことができる。現在の言語における「理解」とは再現性ある操作系列に直すということでしかないが、それを我々は理解と呼んでいる。

ほぼ全ての科学技術は少数のパラメータで物事を理解しようとしてきた。そのため多くのパラメーターをモデル化の外においてきた。自分で物事を再現可能性のある系列にすることができるようになることを理解したと言っているわけだが、系列として再現可能ではないものは理解したとは言わないわけだ。それに対して「高次元科学」とは、多くのパラメーターをそのまま用いようというものだ。たとえばドリフト走行は泥の状態や車の摩擦係数など、モデル化は大変だがディープラーニングは多数のパラメータを用いてモデル化することができる。同様のことはいっぱいあるが、人間の思い込みによって真実は少数パラメーターだと考えてしまった、簡単なモデルのほうが真実に近いと思っているが、そうではないと松尾氏は語った。

たとえば量子力学と化学、政治学と経済学などはきれいには繋がっていない。だが多数パラメーターの途中に少数パラメーターの系が現れることがある。人にも捉えられやすい「少数パラメーターの系が学問分野になっているのではないか」と述べて、「多数のパラメーターさえ使えればモデル化はできるはずだ」と語った。ただし高次元科学は人間には理解できないかもしれない。また、なぜところどころに少数パラメーターの系が出現するのかというと、下のレイヤーを上のレイヤーにあわそうとするとパラメータ数が減ることによるものではないかと述べて、人工物工学のミッションとして、その辺を明らかにしたいと語った。

いずれにしても将来は、人間が「わかった」と言うときに、それが何を意味していたのかが明らかになるはずだ。人間は人間の認知的特性のなかでしかモデル化することはできないので、謙虚になるしかないという。人間がいうところの「わかる」ということ自体に限界があることを認めて、どうやって新しい世界を作るかが重要であり、科学技術のパラダイム自体を大きく変える可能性があると語った。

ヒューマノイドの未解決問題 現実世界の拘束条件を利用して機能を水平分割

独立行政法人産業技術総合研究所(産総研)の梶田秀司氏は、「ヒューマノイドロボットの未解決問題」と題して講演した。梶田氏は最初に2002年ごろに実現した「HRP-2」による人とロボットの協調搬送や不整地歩行の様子を紹介した。HRP-2は研究用プラットフォームで、詳細設計は川田工業が行い、20台くらいが作られて研究用に用いられて販売されている。ヒューマノイドの意義は、1)人間のために作られた環境で自然に活動できる、2)人間と親和性が高い、3)人間の理解に役立つの3つを挙げた。「HRP-4C」はその2番目にフォーカスしエンタテインメントを用途としたロボットで、歌って踊ることができた。

■動画

2011年3月に福島第一原発の事故が起こる。それを受けてDARPA Robotics Challenge(DRC)が始まった。ヒューマノイドに限定した大会ではなかったが、実質的にヒューマノイドのロボコンとなったDRCには、日本の5チーム含め、世界中の研究者たちが参加した。産総研は「HRP-2改」で参加。結果は23チーム中10位。優勝したのは二足歩行にこだわらなかった韓国KAISTのチームだった。梶田氏は「転倒したあとに起き上がれないロボットには未来はないと痛感した」と当時を振り返った。転倒を回避するか、本体を保護するプロテクターが必要だ。それらの研究は既にしていたが、当時は実装されていなかった。

■動画

2018年に発表されたHRP-5Pにはエアバッグが搭載されている。ただし想定重量よりもHRP-5Pは重たいので、転倒時にはロボットの破損が予想されているという。HRP-5Pは重量13kgの石膏ボードパネルを山から持ち上げ、運搬して、釘打ちができるヒューマノイドだ。まだまだ実用化には遠い。

■動画

Boston DynamicsのAtlasがパフォーマンスができるといっても、あれはあくまでデモであって、人並みのことができるわけではない。いまヒューマノイドで盛んに研究されていることは多点接触問題だ。たとえば手すりを掴んで階段を登ったり、車に乗り込んだりするような作業のことだ。想定しない接触を扱うことが難しいロボットにとっては難しい課題である。想定外の接触があると現状のバランス制御では破綻してしまうからだ。また、自力で衣服を着るようなこともできていない。柔軟物も扱えないからだ。一番難しいのは、目標の作業を短時間で実現することだ。たとえばHRP-5Pのビデオを作るには七人の研究者が取り掛かって1年間かかったという。梶田氏は「見栄えのするビデオの背後には膨大な時間のプログラミングとありとあらゆる種類の問題とその解決が必要だ」と述べた。

ディープラーニングでなんでもできるようになるのか。そうではない。AIによる画像認識は格段に向上した。ディープラーニングは悪意ある攻撃に脆弱で、ちょっとしたノイズに弱い。読解力もまだまだ、ないに等しい。一般常識がないからだ。器用な手による器用な物体操作も難しい。2019年4月の「ランドロイド」の破産はその一例だと見ているという。ロボットによる衣服の折りたたみは今もなお難題となっている。

Amazonによるピッキングチャレンジも、難題へのチャレンジの一つだ。2015年に始まったが2017年には終わってしまった。全出場チームが吸引を使っていたからだ。

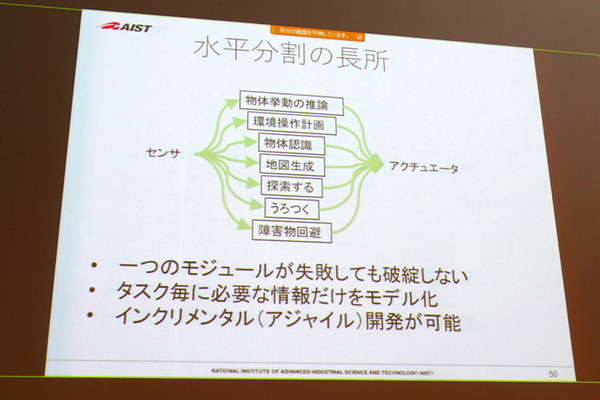

梶田氏は「なんでもディープラーニングを使えばできる、センサを増やし、高精度モデリング、高精度な制御をすればいいという考え方ではうまくいかない」と述べた。この裏には古典的な線形のシステム構成の考え方がある。だがこれには落とし穴がある。一つのモジュールが失敗すれば全てが破綻してしまうからだ。「なんでも深層学習」というのもこれと同じだという。

これに対して、サブサンプションアーキテクチャのように、機能を水平に分割し、それぞれが並列にセンサからアクチュエータへとつながる考え方のほうがメリットがあるという。低レベルがきちんと実装されることで、その上の機能の作り込みが容易になり、付け加えも簡単になるからだ。一つのモジュールが失敗しても破綻しないし、タスクごとに必要な情報だけをモデル化すればいいからだ。現実世界の拘束条件を利用して機能を水平分割し、できるだけ計算量で高速な動作を実現できるという。

梶田氏が注目している研究は二つ。NVIDIAとMITによる研究だ。NVIDAの研究「RMPflow」は避けたい障害物には仮想的な斥力場を、目標には引力を想定し、ロバストな運動制御、リアルタイムな動作生成を実現したというもの。技術的にはポテンシャル法にリーマン幾何学を導入したことがポイントで、運動制御の基本に立ちかえり、ロボット工学の古典的なアプローチを真面目に研究したものだと梶田氏は評価した。

■動画

MIT Csail Tedrake研の「Dense Object Nets」のほうはディープラーニングを使った研究で、物体の表現形式を見直して、様々な色とかたちを正確に認識することではなく、カテゴリーに応じて各部分の性質を理解することがハンドリングには大事だと考えたアプローチ。一つ一つのピクセルがどんなカテゴリにあるかを学習させることによって、たとえば様々な靴をどんな置き方をされても掴むことができる。梶田氏は物体の表象を見直したもので、「最近出てきたロボット工学+ディープラーニングのなかでは、もっとも本質的に重要な研究」と評価した。

■動画

最後に梶田氏は「マニピュレーションしながら同時にモデリングするような機能が将来の動作生成には必要になる」と述べ、「マニピュレーションの考え方自体を変えたほうがいいのではないか」と語った。

MUJINによる産業用ロボット知能化

最後に株式会社MUJINの取り組みが同社モーションプランニングエンジニアの野沢峻一氏から紹介された。MUJINは産業用ロボットの知能ロボットコントローラーの開発と販売、ロボットSI業務を行なっているスタートアップ。デアンコウ・ロセン博士による動作生成の研究をベースにしている。

日本の労働人口は需要と供給のギャップがどんどん拡大しているのが現状であり、自動化に向けて産業用ロボットが必要で、FA現場や物流現場で自動化は進んでいる。だが人手が必要な産業は依然として存在している。たとえば多品種ピッキングなどでは人手が必要な作業が残っている。そのためにロボットのマニピュレーション技術の高度化が必要だ。また、日本では人100人に対してロボット1くらいの普及率であり、さらに爆発的に普及するためには現場での導入課題となっているティーチングの手間を減らす、従来のティーチングベースの方式を革新する知能ロボットコントローラーの開発が必要となる。そこでMUJINでは、同社が開発するMUJINコントローラーとMUJJIN3Dビジョンと繋げることでティーチレスでロボットが必要な動きを自動生成する技術を研究開発して提供している。

■動画

「ロボット工学の未解決問題」とは何かというと、現実の問題を解くことだ。これは二つにわけられるという。問題を解くこと自体と、問題を定義することだ。そして後者は意外と難しい。技術を発展させるためには現場・問題を知る必要がある。そして現場・問題を知るには技術が必要だ。これは完全に、いわゆる「鶏と卵」の関係にある。問題を設定するときに難しいのは問題が先か、技術が先か、というジレンマがあるという。

顧客のところにいって「何かできることがありませんか」と言いたくても、手持ちの技術で自分が何ができるか説明できないと、具体的な問題を掘り下げることができない。手持ちの技術だけで解くことができる狭い問題だけを解くだけでもいけない。だが小さい問題を解決すると技術が出てくる。するとそこを足がかりにして新たな問題を解けるようになって新技術が生まれる。こうしてサイクルがあがっていく。スタートアップにとっては、いかにしてこの輪に入り、実用化のサイクルを上がっていくかが重要だ。

MUJINではモーションプランニング技術に基づく知能化でこの課題に取り組んでおり、FA向け、物流向け、コントローラOEMソリューションの3つの事業を展開している。OEMはエンドユーザーではなくロボットメーカーになりたい顧客向けだ。

野沢氏は、JD.com物流倉庫の事例や、PALTACでのパレットからダンボールを下ろすデパレタイズを行う様子などの事例を紹介した。PALTACではビジョンに基づいてロボットが運動を計画して実行することで数千種のワークに対応している。四台のロボットが稼働しており、二倍の生産性をもたらした。

■動画

バルブ製造メーカーのキッツではバリ取り装置に鋳造のワークを自動供給しており、必要な労働人数が1/4になった。オークマの工作機ARMROIDにはMUJINの技術が導入されており、ワーク交換だけでなく、ワークを削っているあいだに支えるような作業も可能となっている。庫内に入っているのでドアを閉めている状態で作業ができるし、庫内洗浄も可能だ。

■動画

無人技術には3つのポイントがあるという。一般性、フルスタック、稼働主義だ。モーションプランニング技術には高い一般性がある。問題を定義して技術を開発する上では幅広いレイヤーを扱うことになる。そして現場で動かし続けることが何よりも重要だ。

モーションプランニングとは多様な制約を満たした動作軌道の自動生成手法だ。始点と終点、そのあいだの軌道を求めるわけだが、干渉回避、機構制限、モーター特性、把持方法・ハンド姿勢、エラー復帰、検証機能、タスク定義にもとづくスタート・ゴール生成など様々なことを考慮しなければならない。どこからどこに何を搬送するか、運動の目的自体を自動計画する必要があることもある。物流作業においても、デパレタイズ、ソーター投入、ピースピック、デバンニングなど多様な作業があり、必要なロボットサイズも多様だ。

現場で使うためには速度が重要になる。モーションプランニングは探索計算で同じような計算を何度も行うので、一回一回の計算を軽くする必要がある。そのためには制約条件が重要になる。制約条件を定めればロボットの解析解を求めることができる。MUJINでは事前計算や動作計画時計算、生成逆運動学データベースにもとづいて高速に解を求めている。

またMUJINでは、吸着ハンドも把持ハンドも統一的に扱えるようにしているという。把持にも内側把持や外側把持、内外把持など様々あるが、状況に適した動作を計画可能だ。吸着パッド数や吸着可能領域の計画により搬送物を落下させない動作計画もできる。だから支持部と吸着部を統合したハンドも扱えるし、デバンニング(トラックからの荷物の積み下ろし)などにも使える。これについては鋭意開発中だという。トラックのなかの荷物は、キチキチに詰められているので、上からはアプローチできない。横から吸引して引き出し、かつ、下から支えないと難しい。そういうハンドを扱う機能をプランニングにもたせて開発中だという。

■動画

ロボットと通信するためには抽象化したレイヤと外部装置との連携が重要だ。各種センサやウェブサーバ、ログやファイルシステム管理も必要となる。タスクの記述、環境の記述ができる実機制御ユーザーインタフェースやデバッグ・モニタリング、シミュレータなどを透過的に動かす環境も必要だ。

多くのロボットメーカーではロボット制御部分やタスク記述などを行うアプリケーションと、シミュレーション部分とは、それぞれ別のPCにインストールして扱うことが多いが、MUJINではコントローラーと一体化して、シミュレーションと実機制御を統一しているという。

物流現場では繋げる必要のあるロボットハードウェアも多様で、必要なスペックにより求められるハードウェア・メーカーも多様だ。ロボットは単に作業能力だけではなくコストや保守性で選ぶ必要もある。そこで別のメーカーをつないでも実現できる作業能力、既存メーカーだけではなく、新たなロボットにも対応すること、自社のモーションプランニング技術と連携して動く技術が必要になる。MUJINではロボット実機の同定・較正工程も自動化していて、ロボットが自動でキャリブレーションを行うことができる。そのための動き自体も自動計画するという。これらの機能は現場投入においても重要だ。

現場では様々な外部装置—-ビジョンセンサやバーコードスキャナ、AGV、コンベヤ、自動倉庫、そしてもちろんWMS(倉庫管理システム)、WCS(設備管理システム)などなどと連携して、ロボットを動かさないといけない。ロボットの即応性を担保しながら外部装置とタイミングを取ることも重要だ。たとえば箱を積みつけるパレタイズ作業において、積載率を上げながらいかに積むか、どの箱をどのくらい積んでいくべきかといったことが実作業では重要になる。対象ワークはもちろん、かご車やパレットなど載せる対象が違っていても積載率を担保しながら積み付けが可能な技術をMUJINは持っているという。また、ビジョン・力覚センサによって、テクスチャや重量データなどのワーク情報の自動登録が可能だ。

■動画

実際の作業では状況認識にもとづいて投入・一時停止などを実時間で判断・実行する機能が必須となる。認識、計画、実時間反応動作を行うためのモーションプランニングの実時間対応など、守りたい作業制約はいろいろあるという。また、ワークの荷崩れが起こったときなど任意の止まった状態からでも、止まらず動くために、ロボットの自動復帰機能により継続作業を支援できる。

野沢峻一氏は「問題をいかに定義するかが難しいが、解決していくなかで新しい技術が出てくる。それをステップアップしていくことが重要だ」と述べた。MUJINとしては産業用ロボットによる完全自動化を考えており、問題を現場で適切に定義できるか、それを解決するためにコア技術にこだわることで問題解決ができると考えているという。そのためには良いチームとガッツのある従業員が重要だと語った。

■動画

産業界とアカデミア、それぞれの間で、何が解決していない問題で、どのように取り組んでいかないといけないかを突き詰めてもらいたい。