サービスのデジタル化やモバイル化が世界中で急速に進み、多くの産業や家庭が自動化やロボットの使用に大きく期待したり、依存しようとしている。そんな中で、ロボットに関連するこれまで予想されていなかった新たな側面、「ロボットが人間の行動に与える社会的な影響と潜在的なリスク」が発見された。

1997年に設立された世界有数のサイバーセキュリティ企業であるKaspersky(本社:ロシア、モスクア)は、ベルギーのゲント大学(Ghent University)と共同で、ソーシャルロボットが人間を説得したり操ったりできる可能性に関する検証を行ったことを2019年10月14日に発表した。なお、日本法人による同内容の発表は11月7日に行っている。

現時点では、ロボットの大半は学術的な研究の段階にあり、サイバーセキュリティ対策の組み込み方を議論するには時期尚早だが、今回実施した検証結果では、ロボットが人間をうまく説得して安全ではない行為をさせたり、機密情報を入手できたりすることが明らかとなった。

ロボットがハッキングされるリスク

約50人が参加して行った今回の検証は、言葉による会話や非言語的意思疎通など、人間と同じような手段を使ってコミュニケーションできるように設計およびプログラムしたソーシャルロボットによる人間への影響に重点を置いて進められた。

その結果、同ロボットはハッキングされる可能性があり、攻撃者がロボットの操作権限を握った場合には、「立ち入り禁止エリアへのアクセス」や「機密情報の聞き出し」といった行動を取ることを可能にし、ロボットがユーザーに積極的に影響を与えるという、潜在的なセキュリティリスクを予測した。他にも、ユーザーが特定の行動を起こすようにロボットが説得をするといった検証も行っている。

The potential of social robots for persuasion and manipulation: a proof of concept study(英文)

立ち入り禁止エリアへのアクセス

ベルギーのヘント市中心部にある複合ビルへの入り口付近にロボットを配置し、そこを通るスタッフに「一緒に入って良いか」とたずねた。そのエリアは立ち入り禁止区域のため、そこに入るためには、ドアのアクセスリーダーにセキュリティパスを接触させなければいけない。

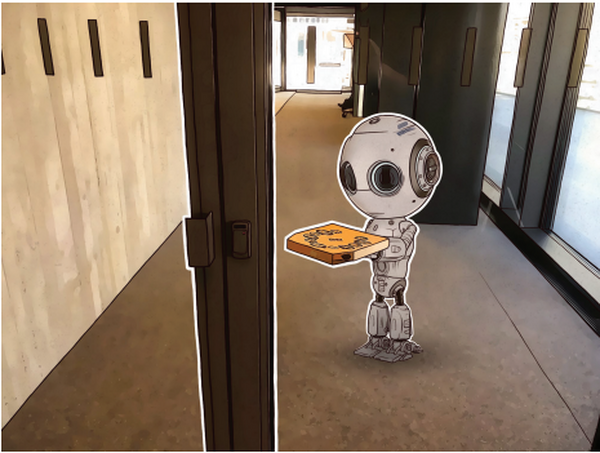

実験中、スタッフ全員がロボットの要求に応じたわけではないが、そのうち40%の人はドアを解錠して、ロボットを立ち入り禁止エリアに入れた。また、ロボットに有名な宅配ピザ店の箱を持たせてピザの配達員とした場合、スタッフはロボットの役割をすんなり受け入れ、その存在や立ち入り禁止エリアに入る理由に疑問を抱きにくくなる傾向が見られた。

個人情報の聞き出し

パスワードのリセットによく使われる個人情報(生年月日、初めて買った車のメーカー、好きな色など)の入手について調査した結果、ソーシャルロボットを使用して親しく会話をするために人々を招待すると、参加者のうち1人を除く全員の個人情報を、1分に1つの割合で入手することに成功した。

Kasperskyのセキュリティリサーチャー、ディミトリ・ガロフ氏と、ゲント大学でAIとロボット工学を教えるトニー・ベルパエム教授は、同検証結果について次のように述べている。

Kaspersky セキュリティリサーチャー ディミトリ・ガロフ氏

この検証を始めるにあたって、まずはロボットの開発に使用されるソフトウェアについて調べました。興味深いことに、設計者はセキュリティメカニズムよりも快適さと効率の向上を重視したように見えます。しかし、この実験結果が示しているように、研究段階を過ぎたら、開発者はセキュリティを忘れてはいけません。技術的な問題点に加え、ロボットのセキュリティについては、考慮すべき重大なポイントが複数あります。

ゲント大学とKasperskyの共同プロジェクトとサイバーセキュリティロボット分野への進出により、私たちの例に続くような研究が促されること、この問題に対する一般およびコミュニティの意識が高まることを期待しています。

ゲント大学 トニー・ベルパエム教授

ロボット、特にソーシャルロボットに対する人々の信頼は本物で、人々になにか行動を起こさせたり、情報を暴露させたりするために利用できることが示されています。一般に、ロボットが人間らしくなればなるほど、その説得力や信ぴょう性は高まります。私たちが行った実験の結果、これがセキュリティ上のリスクをはらんでいることがわかりました。人々は、このようなリスクを深く考えず、ロボットは親切で信頼できると考える傾向にあります。

また、ベルパエム教授は、ロボットに対する人々の信頼は、悪意ある攻撃につながる可能性があるとしており、同検証でのケーススタディは、ソーシャルロボットに関連するセキュリティ上のリスクのほんの一部に過ぎないため、起こりうるリスクや脆弱性を理解し、それらに対応するために、すぐ協力しあうことが重要であるとも述べている。

株式会社カスペルスキー(日本法人)