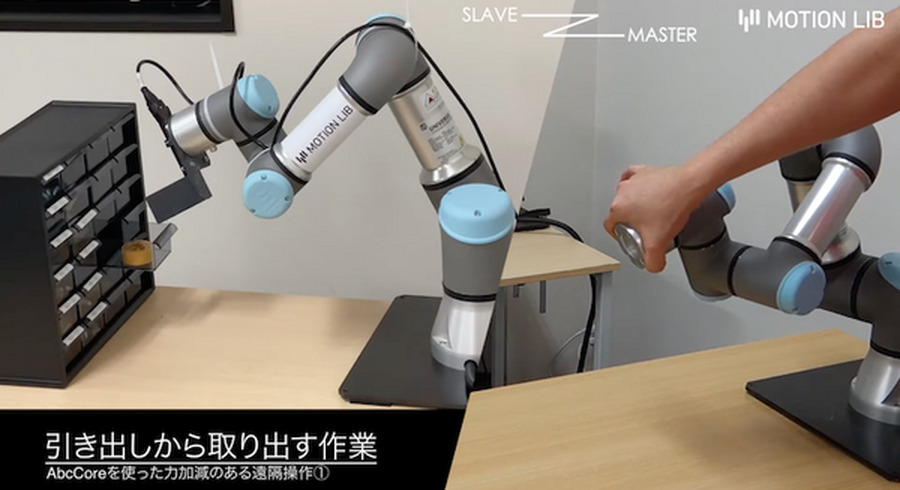

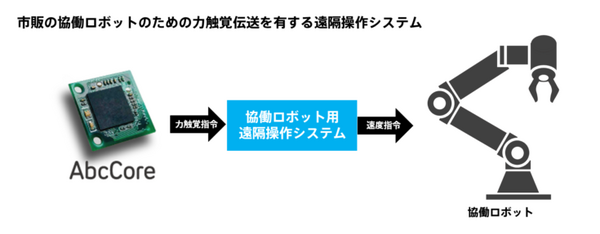

慶應義塾大学発ベンチャーのモーションリブ株式会社は汎用力触覚ICチップ「AbcCore」により、市販の協働ロボットを使って力触覚を双方向に伝送する遠隔操作システムを開発したことを発表した。

これまで力触覚を有する遠隔操作システムをAbcCoreで構築するためには、専用の装置を製作する必要があったため、コストや時間が掛かる傾向にあった。同システムを適用することで、市販の協働ロボットで「作業者の力加減を伴う動作」「作業対象のモノの感触」といった力触覚情報を双方向に伝送する遠隔操作システムを構築することが可能。また、協働ロボットの力加減を直感的に操作できるため、離れた場所からの安全・柔軟な遠隔作業が可能となる。

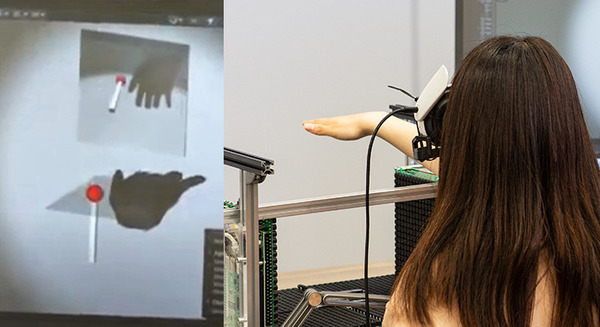

【イメージ動画】

慶應義塾大学発ベンチャー モーションリブ

ロボットの遠隔操作による人手作業の代行は、危険作業における作業員の安全確保や製造・保守作業のリモート化による業務効率改善など、様々な場面での活用が期待されている。また、力加減を伴う作業をロボットの遠隔操作で行う場合、位置や力の力触覚情報をリアルタイムかつ双方向に伝えることが作業効率に影響することが知られている。

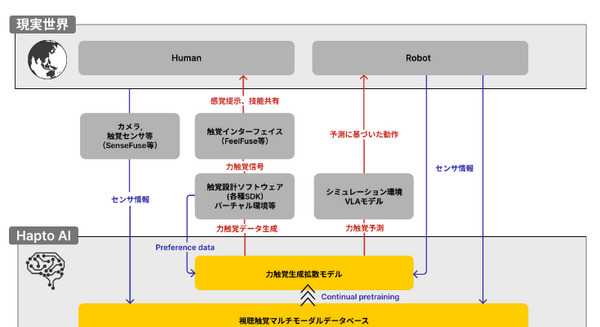

モーションリブは機械が力触覚を自在にコントロールするために必要なリアルハプティクスについて、機械への実装を可能にするための研究開発からキーデバイス「AbcCore」の製造販売まで行う慶應義塾大学発ベンチャー。

「AbcCore」は力センサや特殊なモータなどを必要とせず、市販のモータを使って力加減や力触覚伝送の制御を実現する点に技術的優位性をもっている。この「AbcCore」は、すでに50社以上の企業に先行提供されており、共同研究や実用化が始まっている。

アクチュエータの力加減を思うように制御することができる慶應義塾大学が発明した技術。この技術により、力触覚の可視化・分析、遠隔操作、自動化、感触の再現が可能となる

今回のシステムはリアルハプティクスを利用し、新たなビジネスの立ち上げ及び促進を目的としたリアルハプティクス技術協議会(慶應義塾大学が運営)の加盟企業とモーションリブの共同研究開発の中で提供を開始する。なおモーションリブでは、リアルハプティクスの実用化をさらに加速するために、共同研究企業の募集を積極的に行っている。

汎用力触覚ICチップ「AbcCore」の特徴

・力加減の制御:

リアルハプティクスをモジュール化し、リアルタイムな力加減の計測と制御を実現。

・力触覚を伝送:

力加減をデータ化して、遠隔地に伝送。双方向に力触覚を伝え合うことを簡単に実現。

・力センサレス:

独自の力推定アルゴリズムにより力センサの設置が不要。(力センサの使用も可能)

・高い汎用性:

市販のアクチュエータ・機器を使用して力の制御が可能。既存システムへの組込みも容易。

やわらかいモノをやさしく掴むロボット技術「リアルハプティクス AbcCore」搭載モジュールの提供開始 ネクスティ

【5G時代の遠隔操作ロボット】リアルハプティクス・力触覚の操作体験を展示 SoftBank World 2019で

5G無線通信による力触覚伝送・再現の実証実験に成功 モーションリブのICチップ「AbcCore」を活用

力触覚 関連記事(ロボスタ)

モーションリブ株式会社