国立研究開発法人 産業技術総合研究所(産総研)は、視覚情報から物体間に働く力を想起するAI技術を開発したことを発表した。これは例えば、ロボットがモノを把持する際に、人間のように物体の柔らかさや壊れやすさをAIが視覚情報だけで考慮できるようになること等が期待できる。

この研究開発の特徴を下記のようにまとめている。

・視覚情報だけから「崩しそう」「つぶしそう」と想像する力をAIが獲得

・物体を「壊さないよう」人間らしい推論に基づく行動をAIが立案

・店舗や工場、物流倉庫におけるロボットの作業、カメラによる事故予測などの応用に期待

開発したのは、産総研 インダストリアルCPS研究センター オートメーション研究チームの花井亮主任研究員、堂前幸康研究チーム長、Ixchel Ramirez主任研究員、牧原昂志リサーチアシスタント、原田研介特定フェロー、人工知能研究センター 尾形哲也特定フェロー。

人間は視覚のみから経験的に推論

人間は物体にかかるおおまかな力や物体の柔らかさなどを、視覚のみから経験的に推論し作業することができる。例えば崩れやすそうなものや柔らかそうなものを見つけたら、崩したりつぶしたりしないように丁寧に扱わなければいけないと考える。このように人間は経験に基づき、視覚から異なる感覚を呼び起こすことで、多様な行動を計画することができる。

物理シミュレーター上で視覚と力の関係を学習

この研究では、このような人間らしい「視覚から異なる感覚を想起する能力」をAIが再現することに成功したという。物理シミュレーター上で物体間にかかる力を可視化した仮想的な経験データを構築し、この仮想的な経験から視覚と別の感覚(力)の関係をAIが学習することで実現した。

実験では、カメラ1台で未知の物体間に発生するおおまかな力分布をリアルタイムで可視化することに成功しました。また力分布を理解したロボットが周辺の物体の損傷が小さくなるように指定された対象物を持ち上げるなど、人間らしい推論に基づく行動ができることを確認しました。今後、ロボットによる丁寧な物体操作や、自動運転における事故予測などに役立つことが期待できる。

この研究開発成果は、2023年10月1日から5日まで開催されるロボット分野の国際会議「IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS) 2023」にて発表される。

視覚から運動のダイナミクスを想起

人間は過去のさまざまな経験に基づき、視覚から別の感覚を想起することで柔軟かつ多様な作業を行うことができる。目で見ただけで、柔らかいものや崩れやすいものを丁寧に操作するように意識する。

しかしロボットにおいて、搭載される視覚センサーだけでは、このような感覚を再現することは困難だった。例えば、ロボットにおける運動のダイナミクスに関する推定は、一般的にロボットと物体の接触後に力覚センサーや触覚センサーを使って判断していた。

しかし、この判断法では対象物が崩れてしまうなど、物体に接触してからでは遅い場合において、器用な作業をすることは困難だった。

これに対して、視覚から運動のダイナミクスに関するような別の感覚の想起(クロスモーダル)を簡易に実現することができれば、安価なセンサーから人間のような行動計画を実現することができ、将来のロボットや自動運転システムなどへの貢献が見込まれる。

研究の経緯

産総研は、シミュレーションを利用したロボットの認識や動作生成技術の研究を行ってきた。この研究ではその知見を生かし、画像から物体間にかかる力の分布を想起するAI技術を開発、ロボットへの応用の可能性を探ったという。

なお、本研究開発は、国立研究開発法人 科学技術振興機構(JST) ムーンショット型研究開発事業研究開発プログラム:「2050年までに、AIとロボットの共進化により、自ら学習・行動し人と共生するロボットを実現」(2020~2025年度)による支援を受けた研究開発プロジェクト「一人に一台一生寄り添うスマートロボット(PM:菅野重樹氏(早稲田大学)」の研究課題の一つとして取り組んでいる。

研究の内容

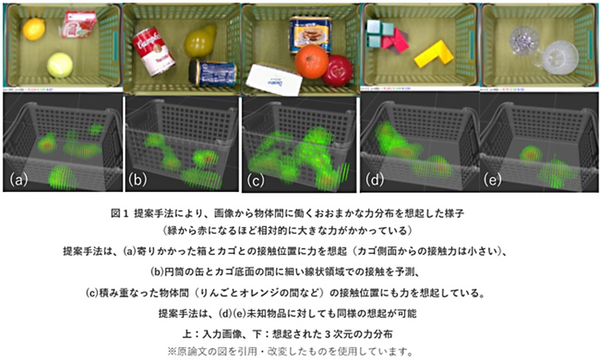

花井氏らは視覚センサーにより得られる画像に写る物体が周囲の物体と接触することで生じる力のおおまかな分布を想起し、リアルタイムに3次元で可視化することに成功した。今回開発したAI技術では、物体同士が接触することで生じる力を画像から推定し、力の大小を視覚的に表現することができる。

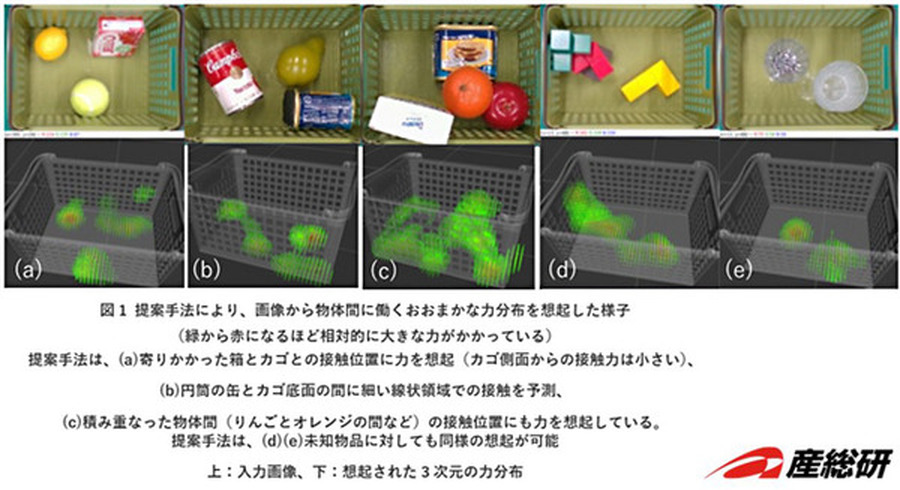

図1がその例。図1の上は視覚センサーによる入力画像、図1の下はその入力画像からAIが想起した力のおおまかな分布を可視化したもの。カゴの中にある物体が(カゴの側面や底面を含む)周囲の物体と接触することで生じる力の大きさを、緑から赤の色で表しており、赤に近い色ほど相対的に大きな力がかかっていることを表している(ただし、図を見やすくするために一定値よりも小さい力は表示していない)。

さまざまなシーンにおいて物体とカゴの側面や底面、物体同士の接触位置周辺に力がかかっている。また対象物にはAIの学習に使われていない未知物体が含まれている。これは提案するAIが多様な日用品に対する汎化性能を獲得できる可能性を示している。さらに提案手法はシミュレーション内で学習をしているが、現実環境に適応するにあたって追加学習をしていないという。

これは機械学習の研究において、ゼロショット転移といわれるもの。仮想世界で学習したAIをそのまま追加学習なしで現実世界に適用できるため、学習効率が良く、応用がしやすいことを表している。このように画像1枚(カメラ1台)から日用品の物体間にかかる力分布をリアルタイムに推定できるAI技術を実現した。

物理シミュレーターの「物体間のおおまかな力の分布」に着目

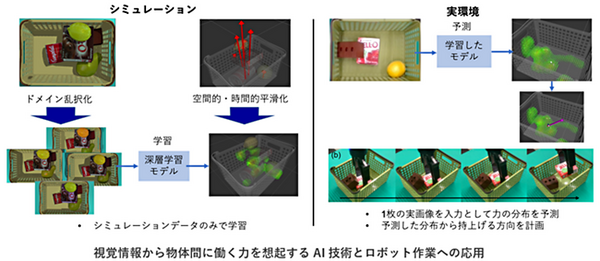

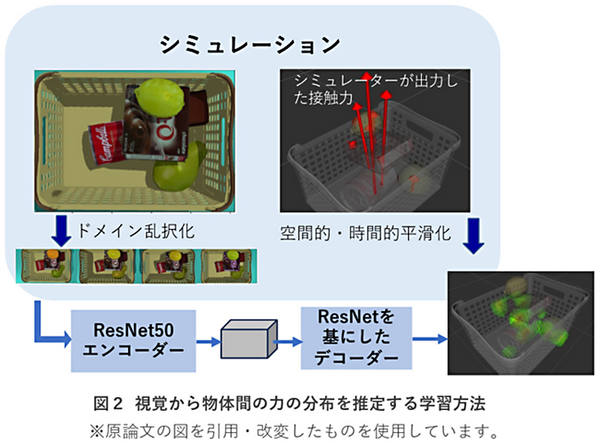

図2は提案手法による学習方法の概要。

視覚情報に対して正確な力分布を得ることは現実世界では困難だ。ここでは物理シミュレーターを使い、ランダムに配置される日用品の3Dモデル間にかかる「物体間に働く力」を物理演算に基づき計算している。しかし、物理シミュレーター上の物理演算は正確に実世界の物理現象を再現できない。そのため、正確な力の量を推定しようとすればシミュレーションと現実のギャップ(機械学習の研究ではドメインギャップと呼ぶ)を埋めるために膨大な労力を必要とする。

そこで研究チームは、正確な物体の力の量ではなく、物体間のおおまかな力の分布に着目。この場合、物理シミュレーションで得られる情報でも時間的・空間的な平滑化を行うことで比較的安定して現象を再現することができる。そのため、AIに大量の経験を積ませなくても、ドメインギャップを埋めやすいことがわかった。

この工夫に基づきシミュレーター上で仮想経験データを生成することで、図2に示すように、視覚的情報を入力し、物体間の力分布を出力する深層学習モデルを訓練した。モデルはResNet50をエンコーダーとし、ResNetを基に設計したデコーダーと組み合わせることで構成した。その結果、図1に示したようにゼロショットでの実カメラへの適用が可能となった。通常シミュレーションを現実に似せることで学習効率を高めますが、今回は「現実では得難い経験」を積ませることで、現実世界での経験を補完した点も、技術的に重要な成果としている。

深層学習モデルが「視た物体形状」と「柔らかさの関係」を学習

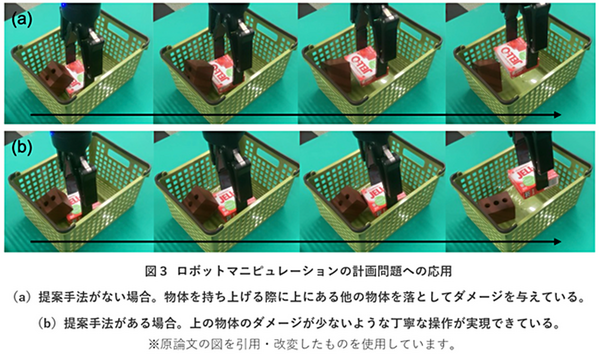

またロボットによる物体操作(マニピュレーション)の計画問題に提案手法を応用した。図3(a)、(b)にあるように、この提案手法を加えることで、視覚情報だけから、人間のような丁寧な物体操作方法を計画できた。将来器用に物体を操作するロボットへの応用が期待される。

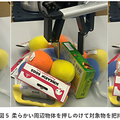

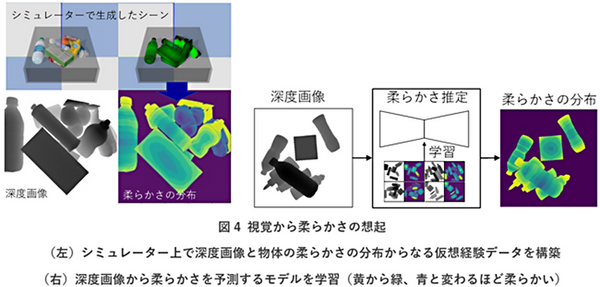

また、これまでに産総研の牧原昂志リサーチアシスタントらは、力の分布と同じような考え方に基づき、物体の柔らかさを推定した[1]。少数の商品の3Dモデルに対して手動で与えた物体の柔らかさを表すマップを貼り付け、シミュレーション上で大量にデータを生成することで、深層学習モデルに視覚(距離画像センサーによる深度画像)から得られる物体形状と柔らかさの関係を学習させた(図4)。これにより、形状から物体の種類が推定できる場合に、シーン中の柔らかさの分布を予測できるようになった。例えばあるペットボトルの形と柔らかさを訓練すれば、少し形の異なる未知のペットボトルに対しても柔らかさを推定できるという。

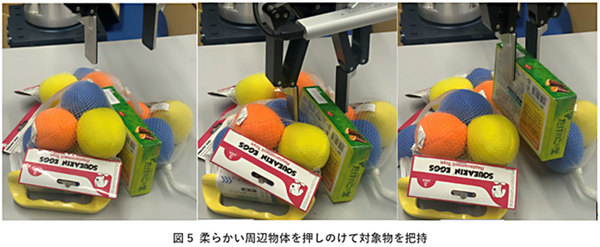

このAIをロボットに適用したところ、物体把持に関する最新手法であるDex-Netと比較して、作業成功率は同等でかつ把持対象の物体のつぶれは70%以上抑えられることがわかった。また、逆に形状だけから判断すると把持できない状況で、柔らかさを利用して周辺のものを変形させて押しのけて把持するという人間らしい行動をロボットがとることにも成功た(図5)。

今後の予定

このような視覚から別の感覚を想起する技術は、安価なセンサーにより人間らしい器用な行動計画を実現する。工場や物流倉庫におけるロボットによる物体操作や、今後家庭に普及するスマートロボットへの展開が期待できる。

またシミュレーションによる経験データの作り方・与え方を工夫することで、自然環境において崩れやすそうな場所を見つけるという応用も想定される。将来的には自動運転における危険予知や、衛星画像からの災害予知など、広い分野への適用を目指す考えだ。

学会情報

IROS2023で発表予定(2023年10月1日から5日まで開催)

論文タイトル:“Forcemap: Learning to Predict Contact Force Distribution from Vision”

著者:Ryo Hanai, Yukiyasu Domae, Ixchel G. Ramirez-Alpizar, Bruno Leme and Tetsuya Ogata

参考文献

[1] Koshi Makihara, Yukiyasu Domae, Ixchel G. Remirez-Alpizar, Toshio Ueshiba and Kensuke Harada, Advanced Robotics, 2022, vol. 36, no. 12, 600–610.

https://doi.org/10.1080/01691864.2022.2078669

産総研 関連記事