NVIDIAは新しいGeForce RTX AIノートPC上で動作する、AIアシスタントとデジタルヒューマンを強化するための新しいNVIDIA RTXテクノロジを発表した。

Project G-Assistを初公開、 PCベースのNVIDIA NIM推論マイクロサービスも公開

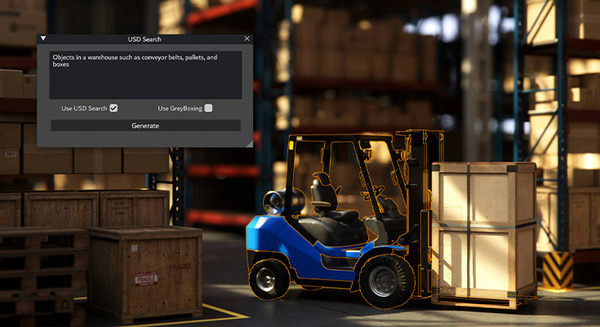

NVIDIA は今回、PCゲームやアプリにコンテキストを認識した支援を提供するRTX搭載AIアシスタントテクノロジデモであるProject G-Assist を初めて公開した。

Project G-Assistテクノロジデモは、Studio Wildcardの『ARK: Survival Ascended』でデビュー。NVIDIAはまた、NVIDIA ACEデジタルヒューマンプラットフォーム向けの初のPCベースのNVIDIA NIM推論マイクロサービスも公開した。

これらのテクノロジは、開発者がWindows PC上で大規模な生成AIモデルを最適化および展開するのに役立つ新しいツールとSDKのスイートである NVIDIA RTX AI Toolkitによって実現される。これらは、500を超えるPCアプリケーションとゲーム、および200のOEMノートPCを高速化するNVIDIAのフルスタックRTX AIイノベーションに加わる。

さらに、ASUSとMSIが新たに発表したRTX AIノートPCには、最大でGeForce RTX 4070 GPUと、Windows 11 AI PC機能を備えた電力効率の高いシステムオンチップが搭載されている。

NVIDIAのコンシューマーAI担当バイスプレジデントのジェイソン ポール (Jason Paul) 氏は

NVIDIA コンシューマーAI担当 バイスプレジデントジェイソン ポール 氏

NVIDIAは、2018年にRTX TensorコアGPUとDLSSテクノロジをリリースし、AI PCの時代を切り開きました。現在、Project G-Assistと NVIDIA ACEにより、1億人を超えるRTX AI PCユーザーにAIを活用した次世代の体験を提供しています

と述べている。

GeForce AIアシスタントのProject G-Assist

AIアシスタントは、ゲーミング戦略の提供やマルチプレイヤーリプレイの分析から、複雑なクリエイティブワークフローの支援まで、ゲームやアプリ内の体験を変革する。Project G-Assist は、この未来を垣間見ることができる。PCゲームには、探索できる広大な世界と習得すべき複雑なメカニズムがあり、これらは熱心なゲーマーにとっても手間がかかる困難な作業だ。Project G-Assistは、生成AIを使用して、ゲーム知識をプレイヤーにわかりやすく届けることを目指している。

Project G-Assistは、プレイヤーからの音声またはテキスト入力とゲーム画面からのコンテキスト情報を取得し、そのデータをAIビジョンモデルに渡す。これらのモデルは、ゲーム知識データベースにリンクされた大規模言語モデル (LLM) のコンテキスト認識とアプリ固有の理解を強化し、テキストまたは音声で配信されるカスタマイズされた応答を生成する。

NVIDIAはStudio Wildcardと提携して、『ARK: Survival Ascended』でこのテクノロジのデモを行った。Project G-Assistは、クリーチャー、アイテム、伝承、目的、難しいボスなどに関する質問に答えるのに役立つ。Project G-Assistはコンテキストを認識するため、プレイヤーのゲームセッションに合わせて回答をパーソナライズする。

さらに、Project G-Assistは、プレイヤーのゲームシステムを最適なパフォーマンスと効率となるように構成することができる。パフォーマンスメトリックに関する洞察を提供し、ユーザーのハードウェアに応じてグラフィックス設定を最適化し、安全なオーバークロックを適用し、パフォーマンス目標を維持しながら電力消費を賢く削減することもできる。

最初のACE PC NIMがデビュー

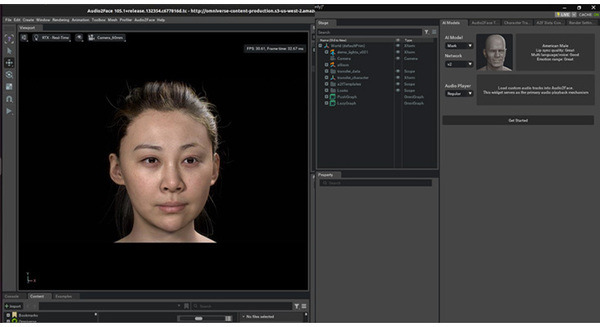

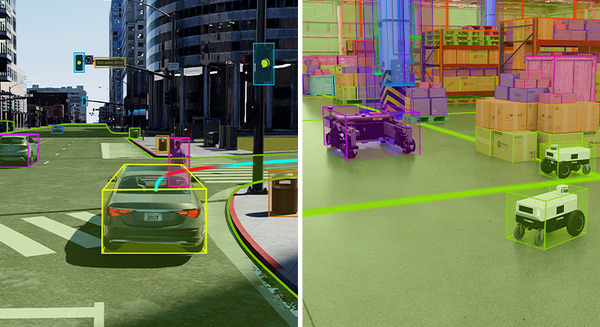

デジタルヒューマンを強化するNVIDIA ACEテクノロジが、NVIDIA NIMを搭載したRTX AI PCおよびワークステーションに登場する。NVIDIA NIMは、開発者が展開にかかる時間を数週間から数分に短縮できるようにする推論マイクロサービスだ。ACE NIMは、自然言語理解、音声合成、ファイシャル アニメーションなどのために、デバイス上でローカルに実行される高品質の推論を提供する。

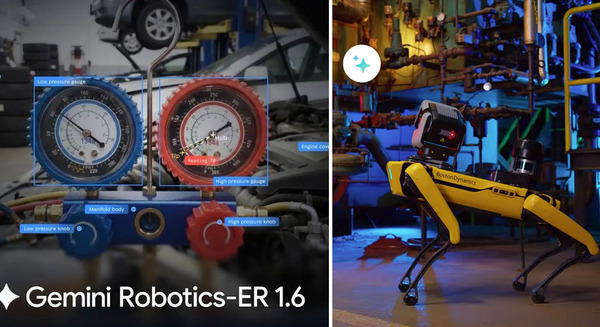

COMPUTEXでは、Inworld AIと共同で開発されたCovert Protocol技術デモで、PCでのNVIDIA ACE NIMのゲーミングデビューが紹介される。このデモでは、デバイス上でローカルに実行されるNVIDIA Audio2FaceとNVIDIA Riva自動音声認識が披露される。

Windows Copilot RuntimeがローカルPC SLMにGPUアクセラレーションを追加

MicrosoftとNVIDIAは、開発者がWindowsネイティブアプリとウェブアプリに新しい生成AI機能を導入できるよう協業している。

この協業により、アプリケーション開発者は、Windows Copilot Runtimeによってデバイス上で実行されるGPUアクセラレーテッドの小規模言語モデル(SLM)とRetrieval-Augmented Generation(RAG)機能にアプリケーションプログラミングインターフェイス(API)から簡単にアクセス可能になる。

SLMは、コンテンツの要約、コンテンツの生成、タスクの自動化など、Windows開発者に多大な可能性を提供する。RAG機能は、基本モデルでは十分に表現されていないドメイン固有の情報にAIモデルがアクセスできるようにすることで、SLMを強化する。RAG APIを使用すると、開発者はアプリケーション固有のデータソースを活用し、SLMの動作と機能をアプリケーションのニーズに合わせて調整できる。

これらのAI機能は、NVIDIA RTX GPUや他のハードウェアベンダーのAIアクセラレータによって高速化され、エンドユーザーにWindowsエコシステム全体にわたって高速で応答性の高いAI体験を提供する。

APIに関しては、2024年後半に開発者プレビューとしてリリースされる予定。

RTX AIツールキットで4倍高速、3倍小型のモデルを実現

AIエコシステムでは、アプリ開発者が活用できるオープンソースモデルが何十万も構築されているが、ほとんどのモデルは一般的な用途向けに事前トレーニングされており、データセンターで実行するように構築されている。

開発者がPCで実行されるアプリケーション固有のAIモデルを構築できるように、NVIDIAはRTX AI PCでのモデルのカスタマイズ、最適化、展開のためのツールとSDKのスイートである RTX AI Toolkitを導入する。RTX AIツールキットは2024年6月にリリースされ、より幅広い開発者がアクセスできるようになる。

開発者は、オープンソースのQLoRaツールを使用して事前トレーニング済みモデルをカスタマイズできる。次に、NVIDIA TensorRTモデルオプティマイザーを使用してモデルを量子化し、RAMの消費量を最大3分の1に抑えることができる。その後、NVIDIA TensorRT Cloudがモデルを最適化して、RTX GPUラインアップ全体で最高のパフォーマンスを実現する。その結果、事前トレーニング済みモデルと比較して最大4倍のパフォーマンスを実現する。

現在早期アクセスで利用可能な NVIDIA AI Inference Manager (AIM) ソフトウェア開発キット (SDK) は、PCとクラウド間でAI推論をシームレスに編成することで、PC アプリケーション開発者の AI 統合の複雑さを簡素化する。また、統一された NIM 形式で必要な AIモデル、エンジン、依存関係を PC に事前構成し、GPU、NPU、CPU などのさまざまなプロセッサで TensorRT、DirectML、Llama.cpp、PyTorch-CUDA など、すべての主要な推論バックエンドをサポートする。

Adobe、Blackmagic Design、Topazなどのソフトウェアパートナーは、RTX PCでのAIパフォーマンスを加速するために、人気のクリエイティブ アプリに RTX AI Toolkitのコンポーネントを統合している。

AdobeのCreative Cloud製品マーケティング担当バイスプレジデントであるDeepa Subramaniam氏は

Adobe Creative Cloud製品マーケティング担当バイスプレジデント Deepa Subramaniam 氏

Adobe と NVIDIA は、ビデオからイメージング、デザイン、3D など、すべてのクリエイティブ ワークフローで画期的な顧客体験を提供するために引き続き協業していきます。RTX PC 上の TensorRT 10.0 は、クリエイター、デザイナー、開発者に前例のないパフォーマンスと AI を活用した機能を提供し、Photoshop などの業界をリードするクリエイティブ ツールでのコンテンツ制作に新たな創造的可能性をもたらします

と述べている。

RTX AIツールキットのコンポーネント(TensorRT-LLM など)は、Automatic1111、ComfyUI、Jan.AI、Langchain、LlamaIndex Oobabooga、Sanctum.AIなど、生成AI向けの人気の開発者フレームワークやアプリケーションに統合されている。

コンテンツ制作のためのAI

NVIDIAはさらに、クリエイター、MOD制作者、ビデオ愛好家向けのアプリにもRTX AIアクセラレーションを統合している。

2023年年、NVIDIAは、最も人気のあるStable Diffusionユーザーインターフェイスの1つであるAutomatic1111向けに、TensorRTを使用したRTXアクセラレーションを導入。今週から、RTXは人気の高いComfyUIも高速化し、現在リリースされているバージョンと比較してパフォーマンスが最大60%向上し、MacBook Pro M3 Maxと比較すると7倍高速になる。

NVIDIA RTX Remixは、フルレイトレーシング、NVIDIA DLSS 3.5、物理的に正確なマテリアルを使用して、クラシックなDirectX 8および DirectX 9ゲームをリマスターするためのMOD制作プラットフォーム。RTX Remixには、ランタイムレンダラーと、ゲームアセットとマテリアルのMOD 制作を容易にするRTX Remix Toolkitアプリが含まれている。

2023年、NVIDIAはRTX Remix Runtimeをオープンソース化し、MOD制作者がゲームの互換性を拡張し、レンダリング機能を向上できるようにした。

2024年初めに RTX Remix Toolkitがリリースされて以来、20,000人のMOD制作者がクラシックゲームのMOD制作に使用し、RTX Remix Showcase Discordで130を超えるRTXリマスターが開発されている。

2024年6月、NVIDIAはRTX Remix Toolkitをオープンソース化する。これにより、MOD制作者はアセットの置き換えやシーンの再照明を効率化し、RTX Remixのアセットインジェスターでサポートされるファイル形式を増やし、新しいモデルでRTX RemixのAIテクスチャツールを強化できる。

さらに、NVIDIAはREST API経由でRTX Remix Toolkitの機能にアクセスできるようにし、MOD制作者がRTX RemixをBlenderなどのデジタルコンテンツ制作ツール、HammerなどのMOD制作ツール、ComfyUIなどの生成AIアプリにライブリンクができるようにする。NVIDIAはまた、MOD 制作者がRTX RemixのレンダラーをDirectX 8および9のクラシック以外のアプリケーションやゲームに展開可能なように、RTX Remix Runtime用のSDKも提供する。

RTX Remixプラットフォームのオープンソース化が進むにつれて、世界中のMOD制作者はより魅力的なRTXリマスターを構築できるようになる。

Google Chrome、Microsoft Edge、Mozilla Firefoxブラウザーでサポートされている人気のAI搭載超解像度機能であるNVIDIA RTX Videoが、すべての開発者にSDKとして提供されるようになった。これにより、開発者はAIをネイティブに統合して、アップスケーリング、鮮明化、圧縮アーティファクトの削減、ハイダイナミックレンジ(HDR)変換を行うことができる。

ビデオ編集ソフトウェアBlackmagic DesignのDaVinci ResolveとWondershare Filmoraに近日登場するRTX Videoにより、ビデオ編集者は低品質のビデオファイルを4K解像度にアップスケーリングしたり、標準ダイナミックレンジのソースファイルをHDRに変換したりできるようになる。さらに、無料のメディアプレーヤーVLC mediaは、既存の超解像度機能にRTX Video HDRを近日中に追加する予定だ。

NVIDIA 創業者/CEOのジェンスン フアン氏のCOMPUTEXに先立つ基調講演を6月2日に配信 AI エコシステムの未来について語る

NVIDIAが外科チームの手術支援ロボット操作スキルを向上するシミュレーションフレームワーク「ORBIT-Surgical」を公開

NVIDIAのデジタルヒューマン・テクノロジーを解説 リアルなアバターやダイナミックなゲームキャラクターを作成する3つの技術

NVIDIA 関連記事

NVIDIA Japan