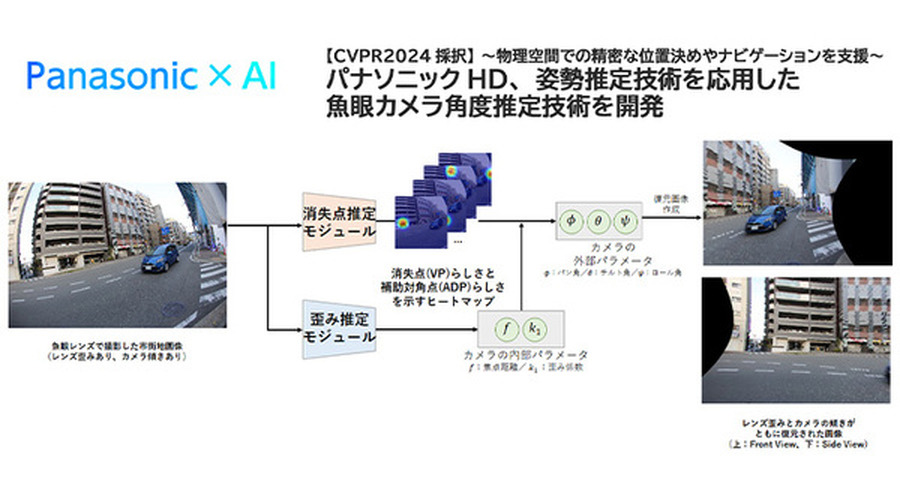

パナソニック ホールディングスは、物理空間での精密な位置決めやナビゲーションなどに欠かせない魚眼カメラの角度を、画像1枚から頑健かつ高精度に推定できる新たなカメラ校正技術を開発した。

魚眼カメラでレンズの歪みにより困難とされている角度推定の課題を解決

自動車やドローン、ロボットなどの自動運転における位置決めやナビゲーションは、高精度に機器の進行方向が推定できることを前提としている。そのため通常、カメラに加えてジャイロなどの専用の計測システムが使用されますが、小型軽量化や低コスト化のためには、カメラの撮影画像のみで高精度に機器の進行方向を割り出す技術が求められている。

そこでパナソニック ホールディングスは、広範囲の映像を撮影できるという特徴から、広範囲監視や障害物検知など幅広い用途で用いられている魚眼カメラにおいて、レンズ歪みにより困難とされている角度推定の課題を解決する技術を開発した。

具体的には、建物、道路などの人工物は互いにその面が直交すると仮定する「マンハッタンワールド仮説」の考え方のもと、姿勢推定に用いられるネットワークを応用することで、レンズ歪みの大きい画像に対しても、頑健かつ高精度にカメラ角度を推定できる技術になる。

開発された手法を利用することで市街地の一般的な画像1枚からカメラ校正を行えることから、自動車やドローン、ロボットなどの移動体を用いた多岐にわたる用途での応用が期待される。

本技術は、パナソニックグループのトップ人材育成プログラムREAL-AIの研究成果として、2024年6月17日から6月21日に米国シアトルで開催されるAI・コンピュータビジョン分野における世界最高峰の国際会議のひとつIEEE/CVF Conference on Computer Vision and Pattern Recognition(CVPR)2024の本会議で発表を行うとしている。

技術の内容

自動車やドローン、ロボットなどの精密な位置決めやナビゲーションを小型・低コストで実現するには、カメラだけでカメラの傾きを効率的に推定できれば理想的だが、さまざまな物体が映りこむ市街地画像において、カメラ角度を推定するヒントとなる地面や垂直方向を捉えることは非常に困難である。

建物、道路などの人工物は互いにその面が直交すると仮定する「マンハッタンワールド仮説」を導入することで推定しやすくなるが、1枚の画像からカメラの角度を推定することは難しく、従来は、無限遠を見たときに収束する点である消失点の座標を複数求め、それらに基づき算出するという方法が取られてきた。この場合、消失点は三次元空間を直交するX軸、Y軸、Z軸の各軸の両端方向からなる6方向に対応している。

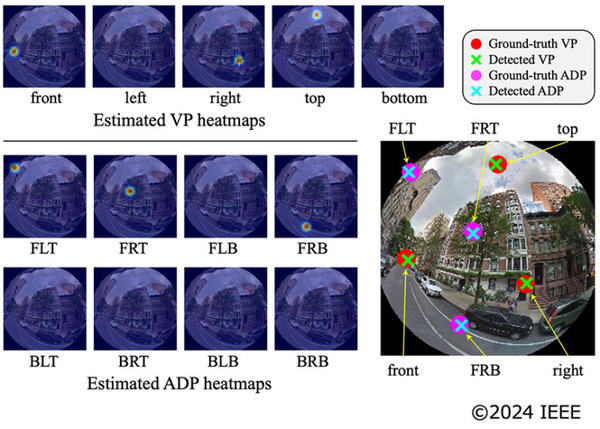

今回提案した手法はこの6方向に加えて、補助対角点と呼ぶ8方向を新たに定義。この補助対角点は、X軸、Y軸、Z軸のいずれに対しても45°または−45°の方向に定義される。これらの補助対角点をAI学習時に消失点と同様に扱うことで推定に利用できる情報量が増え、カメラ角度推定の頑健性と精度が向上した。

また、本手法は人工物の少ないシーンでも頑健な推定を行うために、従来は曲線検出に基づいていた消失点推定に、「ヒートマップ」を用いている。

ヒートマップは、主に人の姿勢推定・骨格検出の分野で、高い頑健性と精度を示し、広く利用されている手法。この考え方を応用することで、消失点の画像座標を直接推定するのではなく、画素ごとにその画素が「消失点である確率」を推定することで、「消失点である確率」が高い領域を消失点の画像座標として推定できるようにした。

本手法のヒートマップで推定した消失点、および補助対角点の座標(図1)から、正確に消失点を推定できていることがわかる。これらの消失点と補助対角点の座標、および、2022年に発表したレンズ歪み推定技術などを組み合わせることで、最終的なカメラの傾きを導き出した。

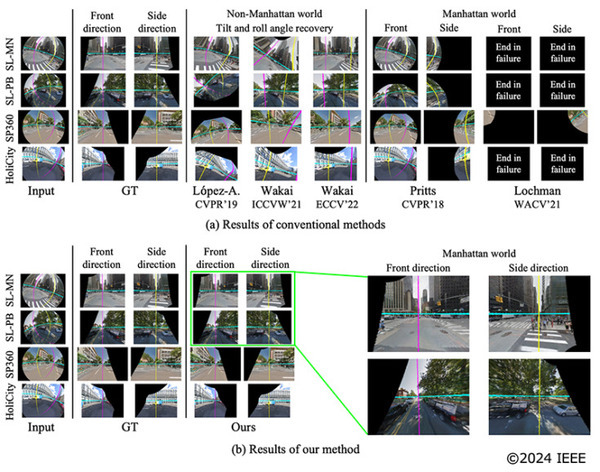

パノラマ画像から作成した人工の魚眼画像データに対する定性評価結果を図2に示す。ここで、傾きとレンズ歪みを視覚的に捉えやすくするために、水平線と垂直方向の基準線を描いている。従来法の結果(図2(a))ではこれらの基準線が傾き、正解画像のように縦横方向の中央で十字状にはなっていないことから、傾きとレンズ歪みの推定に大きな誤差があることが分かる。一方、本手法の結果(図2(b))では水色の線と、桃色線または黄色線が十文字になっていることが確認でき、高い精度でカメラの角度を推定できていることがわかる。

特に、街路樹が多く映り込んだシーンのように、人工物が少なくカメラ角度の推定が難しいとされる入力画像であっても、本手法は高精度にカメラ角度を推定できた。大規模データセットと複数の実カメラを用いた検証により本手法の有効性を検証した結果、世界最高精度を達成した。

今後の展望

本手法は、姿勢推定に用いられる深層学習ネットワークを応用して、たった1枚の画像を入力するだけで、レンズ歪みの大きい画像でも、頑健かつ高精度にカメラ角度を推定できる技術である。特に、機器の進行方向を高精度かつ低コストで推定する必要のある、自動車やドローン、ロボットなどの移動体のナビゲーションや位置決めといった場面における貢献が期待できるとしている。