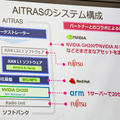

ソフトバンクはNVIDIAとの連携を強化し、通信とAIを統合した「AI-RAN」を積極的に推進し、「NVIDIA AI Enterprize」を採用した、独自の「AI-RAN」サービス「AITRAS」(アイトラス)を発表しました。

ソフトバンクは大胆にも全国20万の基地局に対して、「AITRAS」を設置していく計画を発表しました。

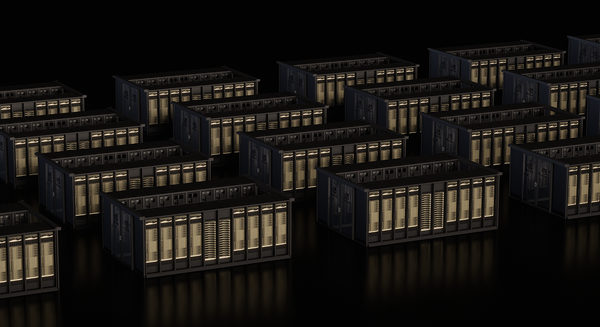

「AI-RAN」は基地局にAIサーバを設置するMEC構想

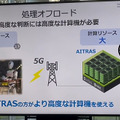

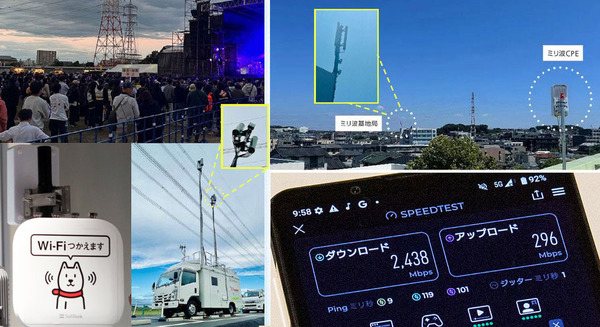

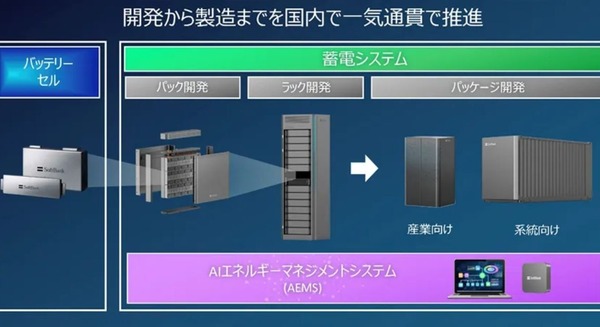

「AI-RAN」は、現行の5G通信からAIを積極的に活用するというもので、具体的には基地局にAIコンピュータ(MEC)を設置することで通信を最適化・効率化(オーケストレーション)、高速化をはかるものです。また、通信量がそれほど多くない時間帯は、AI演算サービスとしても流用します。そのサービス名称が「AITRAS」です。

その内容は関連記事「ソフトバンクとNVIDIAが「通信×AI」で連携 「リセットする」発言の意味、「全国20万基地局をAI-RANで作り直す」ポイント解説」で解説していますので併せてご覧ください。

更に、驚くことにソフトバンクは既に、慶應義塾大学湘南藤沢キャンパス(SFC)に、AI-RANの実験を開始していることです。WIDEプロジェクトのサーバルームにGPUを搭載した「AITRAS」のサーバラックを1基設置し、キャンパス内の建物に20基のアンテナを密集して設置、あえて電波干渉する環境を作り、100台のスマートフォンやロボット、自動運転車両を稼働させて実験を行なっています。

AI-RAN「AITRAS」がもたらすメリット

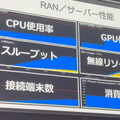

現在すでに、都内など通信の負荷が大きいエリアでは、アンテナを密集して大量に設置し、通信エリア(セル)を狭い範囲で運用しています。一方で、それによって電波の干渉が生じてしまい、通信品質が低下するというケースも起こります。干渉を防ぐためには、アンテナごとのチルトを変更、出力を下げるなど、個別に微妙な調整が必要になります。「AITRAS」では、AIとソフトウェアでこの調整を自動化し、最良の通信品質を得る、という考えです。

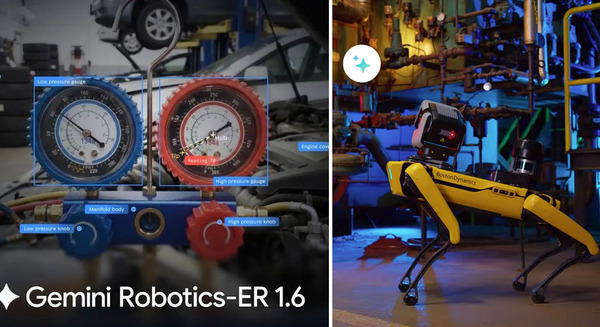

「NVIDIA AI Enterprize」とAI-RAN「AITRAS」を使ったロボットのデモ

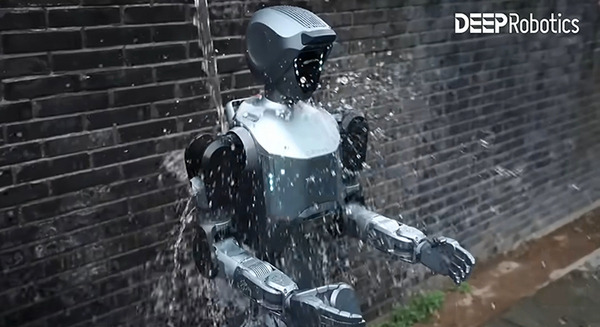

ソフトバンクは11月12日に慶應義塾大学SFCで開催した報道関係者向け発表会で、「NVIDIA AI Enterprize」とAI-RAN「AITRAS」を使って、四足歩行ロボット、大規模言語モデル(LLM)のチャットボット、自動運転バスのデモを公開しました。

四足歩行ロボットのデモでは、警備業界をユースケースにして、「NVIDIA AI Enterprize」上で動作している「AITRAS」が怪しい人を追尾する内容になっていました。今回はそれを紹介しましょう。

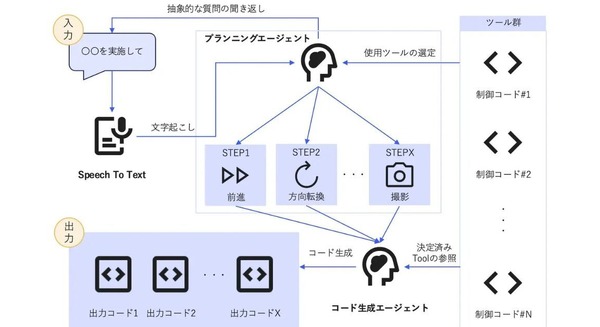

スタッフ同士が会話する場合、「その荷物はそこに置いておいてね」のようなあいまい会話や指示でも、お互い解釈して意味は通じますが、従来のロボットではそうはいきません。従来のロボットであれば「その荷物って何ですか? そこってどこですか? そこに向かってどういうふうにアプローチすればいいのですか?」と行動は逐一、指定する必要がありました。しかも、多くの場合はプログラムコードや専用のアプリで指示をおこなうものです。

それに対して、今回デモで稼働していたLLMと連動したロボットは、それまで過去のやりとりや周囲の環境を解釈して、会話の流れから適切に指示を理解し、意図を解釈して対応してくれる技術が付加されています。

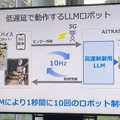

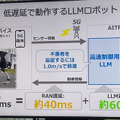

ただ、課題となるのはLLMは大規模なシステムなので、会話や意図を解釈できても、時間がかかる(レスポンスが遅い)という懸念があります。このデモでは20基のアンテナをひとつの基地局で処理していながら、基地局に搭載されたAI-RANのサーバ(エッジAIサーバ)によって処理することで、素早いレスポンスで処理しています。

四足歩行ロボットは画像(ビジョン)やセンサーの情報を高速なレスポンスで処理して、不審者を見失わずに追尾します。デモの例では1秒間に10回、100msで処理をおこなっているとのことです。

デモでは、AITRASを使用せず、遅延が発生した場合の例も紹介。200msの遅延を加味すると、ビジョンのデータが飛び飛びになり、ロボットは不審者を見失ってしまいました。

AITRASの高速レスポンスが警備業務の実用性に大きく貢献していることがわかるデモになっていました。

デモでは表現されていませんでしたが、生成AIやLLMを使用すると、警備ロボットに対して「緑のシャツの人を追尾して」とか「サングラスの人を見張って動きがあったら教えて」といったことを人間の言葉で指示することができるようになると考えられます。

また、サングラスの人を見張って動きがあった場合、ロボットは「ゆっくりと歩き始めました」など、映像やセンサーのデータから解釈した変化を人の言葉で報告できるように、将来はなっていくでしょう。