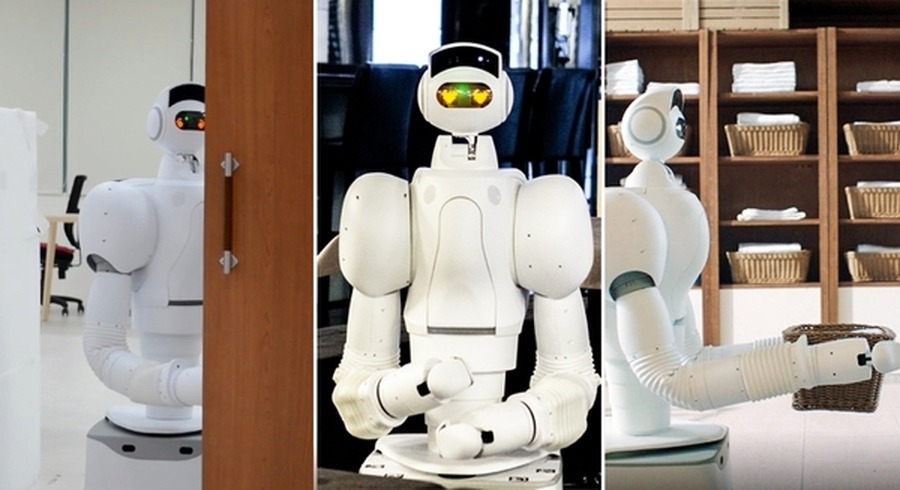

掃除ロボットならルンバがあるのに、あえて人型ロボットにハンディ掃除機を持たせる。海外で話題になっていたヒューマン支援ロボットが日本に上陸する。

米サンフランシスコを拠点に置く「Aeolus Robotics」(アイオロス・ロボティクス)社が開発した自律型ロボットで、名前は会社名そのままの「アイオロス・ロボット」だ。

この「アイオロス・ロボット」、聞けば聞くほど「そんなことが本当にできるの?」と驚かされることの連続。AI関連技術をふんだんに搭載し、エレベータに乗ってフロアを移動し、作業に合わせて最適なロボットハンドに自分自身で交換すると言う。更にはクラウドは使わず、AI関連機能を端末だけで動かしている。今回はそれらの技術とコンセプトの一端を詳細に解説していきたい。

AI搭載ヒューマン支援ロボット アイオロス・ロボットを発表

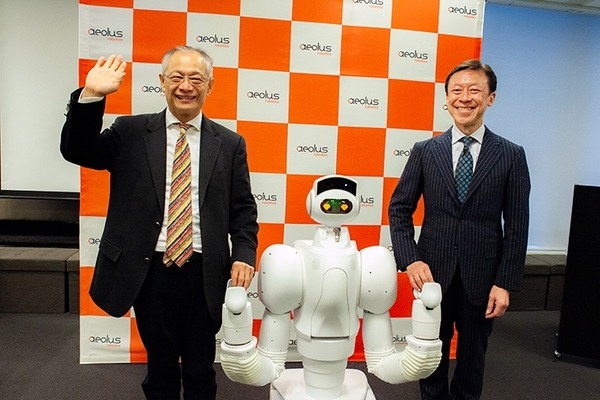

11日、都内で「AI搭載ヒューマン支援ロボット アイオロス・ロボット発表会」が開催され、アイオロス・ロボティクス社のCEOのAlexander Huang(アレキサンダー・フアン)氏が登壇し、日本市場向けに介護分野にまず注力していくことを発表した。

レンタル月額は15万円を予定し、故障時やメンテナンスに関わる費用も含まれる。来年4月に予約を開始し、リリースは8月を予定している。今後、販売代理店や開発のパートナーを積極的に募り、エコシステムを構築していきたい考えだ。

また、高齢者住宅経営者連絡協議会の会長をつとめる森川悦明氏も続いて登壇し、専門家からみた介護現場の実状とロボット導入について解説した。

講演の様子は後日、別の記事でお伝えする予定だが、森川氏の講演に先だって、アイオロス・ロボットから森川氏に記念品として巻物をプレゼントする演出が行われた。(アクチュエーター関連の音などが確認できる)

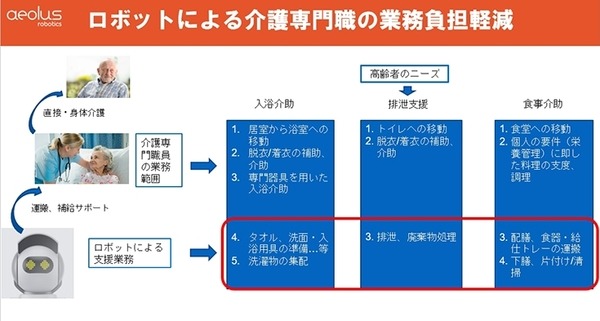

介護現場でのロボット活用

介護の現場ではアイオロスロボットは何ができるのだろうか?

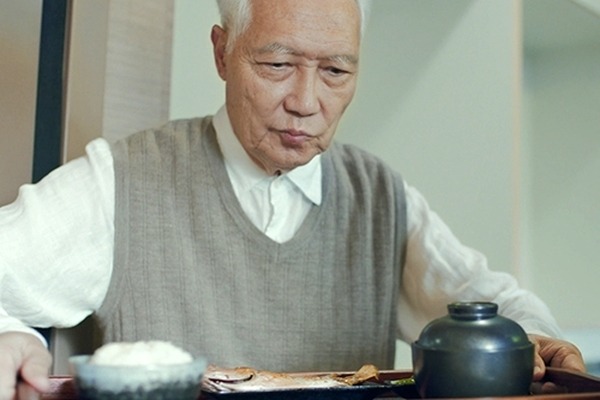

それを示したイメージ動画の構成はこうだ。

前半はロボットの視点からストーリーが描かれている。

まずは介護士にロボットがタオルを運ぶ風景が見られる。

次に見守り。お年寄りが転倒したり、具合が悪そうにしているとそれを検知して、介護スタッフのスマートフォンに速やかに通知する。

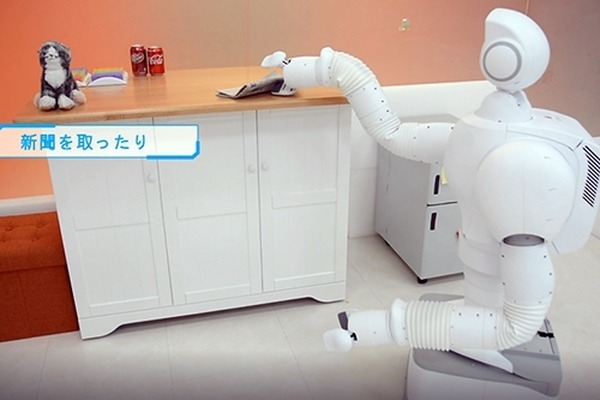

新聞や食事、手紙などをお年寄りに届ける様子も描かれている。

ロボットの視線で見たお年寄りの様子を介護スタッフがスマートフォンでチェックすることができるので、「どうも元気がないなぁ」と感じる介護士。元気づける方法をひらめいた。

介護スタッフが「書道の道具をとりに行って欲しい」とロボットに指示。

後半はそれらの作業をロボットが行う様子が、機能や要素技術の紹介とともに描かれている。

■ アイオロス・ロボットを介護施設で活用するイメージ動画

アイオロス・ロボティクス社とは

同社は米サンフランシスコのほかに、オーストラリアと香港にも拠点を持ち、来年1月に日本法人も設立する見込みだ。実質、そこからが日本市場向けビジネスの本格的なスタートとなるのではないだろうか。

海外では既にさまざまな国と地域で実証実験を含めて導入が進められている。アジア・オセアニア地域でもオーストラリア、シンガポール、中国等で導入され、介護施設、セキュリティ警備、工場のリアルタイムモニタリング、ホテルや空港、公共施設などで活用されていると言う。

気になるその「アイオロス・ロボット」の仕様と特徴、能力を見ていこう。

アイオロス・ロボットの機能

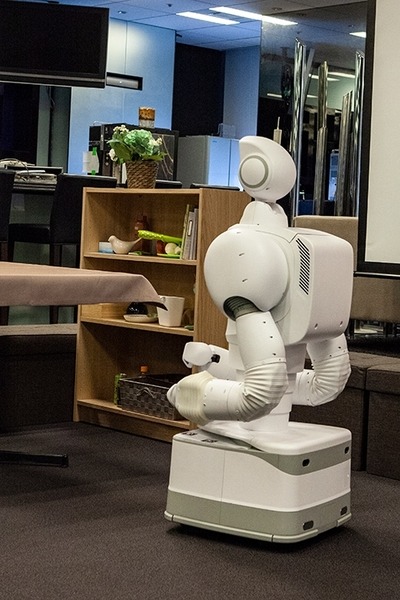

アイオロス・ロボットは見ての通り、2本のロボットアームを装備し、顔部のLEDで簡単な表情を作ることができる自律型ロボットだ。身長は1023mm ~ 1323mmで伸び縮みする機構を採用している。体重は62kg。

身体性能のデモはほとんど見ることはできなかったが、動画を見たり、技術的なしくみを聞いていくと、今までにない新しい考え方や先進技術が搭載されていて、いわば次世代の水準を実現したと言える、実に興味深いロボットになっている。

顔を認識し、どんなポーズかも検知できる

頭部には前方を見るRGBカメラとデプスカメラを装備している。これらのカメラを使ってムービーの中で描かれていたように、人やモノの検知、認識などを行うことができる。

認識については顔認識機能を装備し、登録済みの人はリアルタイムに検知することができる。また、登録はスマートフォンのアプリを使って(iPhoneのFaceIDの登録のように)顔を様々な角度からカメラに認識させることで、介護スタッフなど一般の人でも簡単に登録作業をすることができる。

■スマートフォンで顔を登録するデモ

また、デプスカメラによって人を骨格で認識し、後ろを向いているときでも誰の身体なのかを判別して追従できるとともに、倒れている、横になっているなど異常事態を認識して通知する機能もある。

ロボットアームは10kgのものも運べる

両腕にロボットアームを装備している。このアームは約2kg程度までのものをつかむことができ、両腕に抱えるように持つ場合は胴体に支える機構と相まって約10kg程度のものまで運搬することができると言う。

ハンド部のグリッパーには圧力センサーを搭載し、ものをつかんだときの反発を検知するため、柔らかいものでも持つことができる。

手はロボット自ら入れ替え可能

グリッパーは、五指のあるものなど、他の形状のハンドも準備中だ。何より面白いのは、それらのハンドはロボットが自身の意志で交換することができると言う。各種ハンドの置き場を決めておけば、今装着されているハンドをはずし、別のハンドに組み替えることができると言う。例えば掃除機を持つのに適したハンドやエレベータに乗るのに適したハンドなどだ。ちなみにバキューム型のハンドは用意されていない。これはあくまで人間の機能に似せてロボットを開発しているためのこだわりのようで、人間と同様につかむ仕組みのグリッパーのみの採用にとどめている。

LiDAR、超音波センサーなど搭載、SLAMで制御

移動には車輪を四輪で構成。二輪駆動で進む。センサーとマッピング技術を使い、自社開発のSLAMで制御する。

胴体と脚部のすき間にLiDARが埋め込まれている。

脚部には超音波センサーと赤外線の近距離センサーを前後に装備している。

マッピングは一度施設の内部を走行すれば自動で行われ、椅子の位置が変わっていたり、障害物がある場合などはセンサーで検知し、ダイナミックにマップや行動可能範囲を更新するしくみだ。ルート上に障害物があったり、人がいる場合は周囲を認識して、最も広くて安全な迂回ルートを選択して移動すると言う。

バッテリーは重量配分を考えて、下半身の脚にあたる部分に装備されている。充電が約4時間で稼働も4時間。充電ドッグ(ステーション)には自律的に戻って充電することができる。また、スライド式の脱着型バッテリー構造のため、誰でも簡単に交換ができると言う。また、今後、ユーザーからの要望が多ければ、容量の大きなバッテリーも用意することは可能だとしている。

物体の認識と登録

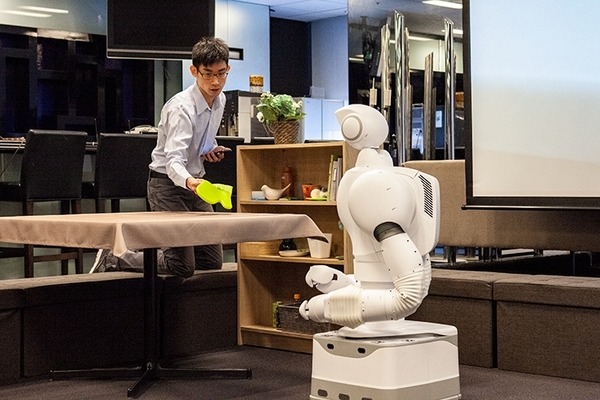

物体の認識は、既に機械学習によって壁や階段などの構造物、テーブルや椅子などを含めて、基本的なものは学習済みだ。また、日用品などもある程度は既に理解できるとしている。デモではテーブルの上に日用品などを次々に置くと、それがなんであるかを認識して画面上に名前を写し出していた。また、それらの登録も顔認証と同様に、ユーザーが学習させたい物体の写真をいろいろな角度からスマホのアプリで撮影し、名称を付けることで学習させることができる。その際、つかむときにはどこを持つべきかなどの情報も後から学習させることができる。

驚いたことにタオルのように形状が流動的なものも認識することができ、(登録してある)誰のタオルかを識別することも可能だとした。

AlexaとGoogleアシスタント対応も

ロボットに対するコマンドは、周囲の人間が話しかけることによって行う方法とスマートフォンやタブレットのアプリ等を通じて行う方法の二種類がある。音声認識はAmazon AlexaやGoogleアシスタントと連携できる。米国などの英語圏ではAmazonやGoogleを通じた音声会話で問題ないが、日本語の認識は弱いと感じているので、日本語は音声認識を開発している日本の企業とのタイアップが進行しているという。

エレベータにも乗れる

現在、掃除ロボットなど、移動可能なロボットの業界ではエレベータとの連携がひとつの課題になっている。アイオロス・ロボットはヒューマノイド型だけあって、これを人と同じ方法で解決しようとしている。先のイメージ動画にもあったとおり、このロボットはエレベータを使って階を移動することができるという。それはエレベータと通信などで連携するのではなく、人間と同じようにボタンを押してエレベータを呼んで乗り込み、行先の階もボタンで指定する。

エレベータに他の人が乗っていれば、ロボットの行きたい階の手前でエレベータが止まることもあるはずだが、指定した階に着いたかどうかも人間と同様にエレベータに備え付けられた現在のフロア表示のランプを見て確認すると言う。それを実現するために、多くのエレベータの操作パネルのデザインやパターンを学習し、判別し理解できるようにモデル化している。

階が変われば、到着したフロアのマップを参照して自律的に移動するしくみだ。

基本はスタンドアローン

更に驚くべきことに、これらの機能を実現するのにクラウドロボティクス技術は必要なく、エッジ側ですべて処理してスタンドアローンで動いていると言う。比較的高性能なCPUとGPUを搭載し、顔認識や物体認識、SLAM等、AI関連の学習を含めてすべてをロボット内で処理できる。また、学習したものを他のロボット端末と共有するためにクラウド経由で転送することは可能だと言う。まるで攻殻機動隊のタチコマの並列化のようだ。

開発は世界各地からリモートで

エンジニアはそれぞれの機能のスペシャリストが世界各地に点在し、ネットワーク経由でリモートで開発に当たっている。能力の高い精鋭部隊でこれらの機能を開発していると言う。なお、オープンにSDKを公開するのか、外部開発者との連携などについての具体的な発表については今回は聞けなかった。

ただ、パートナー連携を重視したり、エコシステムとして提供したい、という発言はあったので、今後はそれらについての発表がされる可能性は高いと感じた。

リリースは来年8月

人の代わりに物を運搬したり、姿勢を識別した見守り機能など、実際に役に立つ機能を目指して開発されているロボットだ。物も持つハンドを自律的に入れ替えられたり、エレベータをハンドで操作したり、従来にはなかった新鮮なアプローチが面白い。これらが実際に実現できるのかどうかは、来年8月のリリース時期を楽しみに待ちたいと思う。

また、用途に合わせてデザインされたロボットが多い中で、あえて人間のしくみにこだわったこのロボットが受け入れられるのか、次世代のロボットを占う試金石になると感じた。

jp.information@aeolusbot.com

※@は半角に変換してください。問合わせは日本語対応可能