2022年5月11日から13日の日程で「New Tech Week 春」が東京ビッグサイトで行われた。そのうち「第6回 AI・人工知能EXPO」の「アカデミックフォーラム」では内閣府ムーンショット型研究開発 目標3 「自ら学習・行動し人と共生するAIロボット」に関するパネル展示や講演も行われた。

今回は特に「人とAIロボットの創造的共進化によるサイエンス開拓」、つまり、サイエンスを探求する自律型AIロボットの開発のコンセプトに関して、プロジェクトマネージャーの東京大学 准教授の原田香奈子氏らが「人とAIロボットの創造的共進化」と題して紹介した。そのほかの講演内容も織り交ぜながら、ざっとご紹介しておきたい。

なお、「ムーンショット目標3」全体については、2021年9月にも一度レポートしている。合わせてそちらもご覧いただきたい。

■動画

段階を経て完全自律でサイエンスを行えるAIロボット開発を目指す

サイエンスは人間の営みだが、昨今、AIとロボットを使って科学実験を自動化する試みがMITやリバプール大学等、世界各国で行われている。なかには人間では数年や数ヶ月かかる実験を数週間、あるいは数日で完了させることができたとレポートされているものもある。国内でも実験作業を自動化するプロジェクトは進行中だ。

ムーンショット3で原田氏らが目指しているのは単純なラボオートメーションではなく、もっと根本的なレベルでサイエンスを行えるロボットの開発だ。そもそもサイエンスとは観察から仮説を立て、実験を行い、その結果を観察したり実験データを検証するなど複数段階を経て絞り込んでいく過程である。そのようなことをロボットが自ら行うには、ロボットは、自分自身の身体を通じて実世界と繋がって、対象物を操作して、仮説検証サイクルを自らの頭のなかで回さなければならない。そのための「頭(AI)」と「体(ロボット)」の両方を開発しようというのがこのプロジェクトの目標だ。

チームには数理関係の研究者やロボットの研究者たちが集まって、まずは植物のバイオスティミュラント(生物刺激剤)の開発や、好適培地の開発などを目指している。まずは人間がAIに選択肢を与えるが、徐々にその制限を少なくしていくことで、自動運転技術のように部分的な自律化、条件付き自律化、高度自律化といった段階を経て、2050年には完全自律化を目指す。

サイエンスの探求、つまりAIを使った仮説発見・設計の自動化部分については、名古屋大学の竹内一郎教授らが中心となって研究を進めている。竹内教授の講演によれば、仮説とは、より単純な仮説の組み合わせでできていると考える。そして、仮説を選択し、組み合わせ、評価を行うことが重要となる。たとえば化合物はグラフ構造で表現できるが、膨大な組み合わせが可能だ。そのなかから有用なものを潜在空間で探索する必要がある。AIから出てきた仮説に対してどのように信頼性を与えるのかがキーとなるようだ。

卵の薄皮を破らずに殻だけを削る

では実際には、どんなロボットを開発するのだろうか。原田氏らはもともと手術ロボット、特に赤ちゃんや小児へのマイクロサージャリー(微細手術)を対象にした手術支援ロボットの開発を行っていた。JST ImPACT『バイオニックヒューマノイドが拓く新産業革命』では先端が屈曲できる3.5mmのロボット術具を開発しており、動物を対象にした理化学実験にも適用できる。ちなみに手術ロボットで有名な「ダヴィンチ」の鉗子の太さは8mmだ。

■動画

具体的にはオルガノイド(生体外で作られたミニ臓器)を開発した東京医科歯科大学の武部貴則教授らと、血栓性微小血管障害症(thrombotic microangiopathy:TMA)の解明に挑む。その実験にはマウスを使うが、処置には熟練が必要だ。マウスの薄い頭蓋骨に直径8mm程度の小さな穴を開けて処置を行う必要があるからだ。

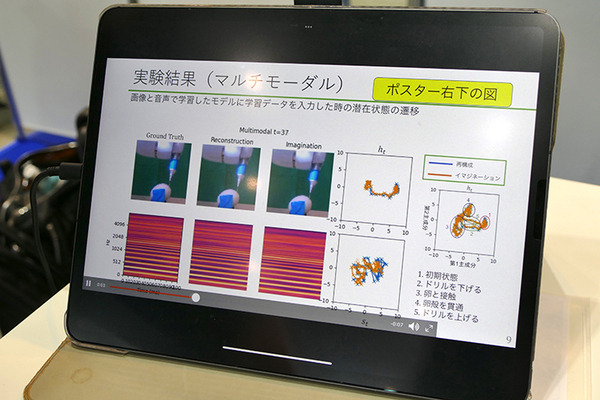

研究グループでは、まずはこの作業の自動化を進めている。マルチモーダル情報をもとにした統合的な確率生成モデル(予測モデルの一種)を研究している立命館大学の谷口忠大教授らが主に担当しており、ロボット自身が複数の感覚情報(音と視覚情報)をもとに、適切なサイズの穴を開ける。いきなりマウスは難しいので、今はマウスの頭蓋骨に似ている、卵の薄皮を破らずに殻だけを削る作業を行なわせているという。谷口教授の講演によれば、視覚情報だけではうまくいかなかったが、音情報を組み合わせることでロボットは適切な作業が行えるようになったとのこと。

マルチモーダルな再帰型状態空間モデル(Recurrent State Space Model)を使って、ロボットは画像情報と音声情報の両方を予測しながら作業を行う。複数のモダリティを使って状態空間を作り、予測を行うことで、単に情報が増えるだけではなく裏にある構造に気づくことができる。「これは非常に拡張性が高い」と谷口教授は語った。なお谷口氏には一般向けの著書もいくつかあるので、より詳細を知りたい方はそちらを合わせて読むことをおすすめする。

実際に作業を行うためのロボットには、デンソーウェーブのロボット4台が用いられている。ロボットは自分自身の感覚情報や、自分自身の足元の自由度なども自分でコントロールして配置を決定しながらタスクを達成する。将来は、自分自身にできない作業や、人間の手助けが必要な作業なども、人と一緒に作業を達成できるようにしていく計画立案や技能発見ができるAIの開発を目指すという。

予測符号化によるロボットの制御

このほか、「第6回 AI・人工知能EXPO」では早稲田大学理工学術院の尾形哲也教授が「深層予測学習によるAIとロボットの共進化と実世界応用」と題した基調講演を行った。これも上の話と関係があるので合わせて、ご紹介しておきたい。キーワードは「予測符号化」である。

尾形教授はまず、「学習モデルの不完全性」をベースとすることで機械学習の視点を変えるべきだと述べた。ロボットが環境とインタラクションを行うためには予測符号化が重要だと述べた。これはシステムが事前に持っている世界モデルと、実際に行動を行ってセンシングしたときの誤差を最小にするための方策だ。尾形氏は脳の情報理論の一つでフリストンが提唱している「自由エネルギー原理」を紹介し、予測に合うように(自由エネルギーを最小化するように)身体を使って知覚あるいは行為を能動的に実施してベイズ推論を行うことが予測符号化であり、これをロボットに導入したいと述べた。

この考え方に基づき、尾形教授らは、これまでに深層予測学習を使ってタオルをたたむ動作の学習や粉体や液体の計量、ハーネスの組み付け、布製バッグのジッパー開けなどを実現してきた。これらもすべて、ロボットの軌道を人間が与えるのではなく、ロボット自身が、自身の予測誤差を小さくするための行動を生成することで軌道を生成している。ロボットは視覚情報、自身の触覚センサや力覚センサの情報なども予測しながら動作する。

■動画(19秒くらいから)

つまり、ロボットが動作することは、単なる環境への働きかけではなく、能動的に世界を探索する仕組みでもある。たとえば対象が液体であれば、かき回したりすることで、その性質を探ることができる。

ディープラーニングと予測学習モデル技術を用いた尾形教授らの最近の成果の一つが、ロボットの全身運動、具体的にはドア開けだ。学習してないドアや、人が邪魔をしても開けることができる。

■動画

尾形教授らは、柔らかい身体を持ったロボットを予測学習で制御させることで、汎用的に動けるロボットを開発しようとしている。目指すところは、あくまで人間を主役としつつ、それを傍から助けられるようなロボットだという。

■動画

■マルチモーダル情報の活用+予測がロボットを賢くさせる

このように、複数の感覚情報を組み合わせることで世界のモデルを構築し、そこに対して絶えず予測を行い続けることで、変化する世界に対応できる柔軟な制御へと繋げるという考え方が、学術の世界では大きなトレンドになっている。実用の世界にどれだけ近づけられるかは未知数だが今後もここに注目していきたい。