「GTC 2026」会場で2026年3月18日、ロボスタ編集部はNVIDIAとメルセデスが共同開発する自動運転「Alpamayo」(アルパマヨ)を搭載した「メルセデス・ベンツCLA」モデルに試乗する機会を得た。

自動運転機能は「NVIDIA DRIVE AV」によるpoint-to-pointのレベル2 (level 2++)を搭載したCLAで、基本的には市販車ベース(特別に用意されたプロトタイプではない)にNVIDIAの自動運転スタックを搭載していたものだ(GPUはORINを1基搭載)。

スタート地点のヒルトン・シグネチャ・ホテルを出て、サンノゼ近郊を40分間に渡り、自動運転の乗車体験ができる内容だった。私達記者のほかに、NVIDIAのドライバー(補助的に搭乗)と「Alpamayo」説明員が乗車した。ホテルを出た直後、すぐに自動運転モードに切り替わった。

NVIDIAとメルセデスの自動運転デモ「Alpamayo」の特徴

NVIDIAとメルセデスの自動運転デモ「Alpamayo」の担当者は、今回の試乗で披露したシステムについて詳しく解説してくれた。

まずHDマップに依存しない認識・判断の仕組みをとっていること。今回のデモ車両は、カメラとレーダーを主なセンサーとして使い、道路上の状況をリアルタイムで理解しながら走行していた。停止線、路面上の「STOP」などの文字、車線の種類、右左折レーンの意味、縁石、道路境界、速度標識、信号、歩行者、自転車、停車車両、ゴミ箱、コーン、色の違う舗装、薄くなった白線などを総合的に読み取り、その場その場で進路判断を行っているという。

担当者の説明で印象的だったのは、単に「見えたもの」を検出するだけでなく、文脈から意味を推定している点だ。たとえば、木の陰などで停止標識そのものが見えにくくても、路面の停止表示やレーン形状、交差点の文脈から「ここはおそらく停止すべき場所だ」と判断する。また、道端の人が少し後ろに下がっただけでも、その速度ベクトルが進路側に入る可能性を読み取って減速するなど、対象物の存在だけでなく動きの変化や進路へ侵入する可能性まで見ていることが分かる。これは人による運転での行動によく似ている。

さらに、この車両は「見通しの悪い状況での慎重な前進」も行っていた。たとえば、カリフォルニアでは多くの交差点で赤信号でも右折が許されている(一部で禁止標識のある交差点もある)。駐車車両などで横方向が見えにくい場合、完全停止した後に少しずつ前へ出て視界を確保し、左から来るクルマがないかを確認しながら右折していた。いわゆる“creep”動作である。これは、ただ止まる・進むの二択ではなく、見えない状況を自分で改善しながら判断する行動であり、都市部の自動運転では非常に重要な挙動といえるだろう。

交差点の種類の違いも理解

同様に、交差点の種類の違いも理解していた。二方向停止の交差点では、自車側だけが停止義務を負うことを理解して慎重に進入し、四方向停止では他車も止まる前提でよりスムーズに通過する。信号についても、複数の信号灯が並ぶ場所で「どの信号が自車のレーンに対応しているか」を区別していた。左折専用信号と直進用信号を見分け、遠くの信号が青でも手前の自車用信号が赤なら停止を継続する、といった判断である。こうした説明からは、Alpamayoが個別の物体認識を超えて、道路構造と交通ルールの対応関係そのものを理解しようとしていることがうかがえる。

また、道路の難しい場面をどうリカバーするかという点では、担当者は多くの具体例を挙げていた。

たとえば、

・消えかけた古い車線と新しく引き直された車線を見分ける

・合流レーンの矢印を見て他車の流入を予測する

・一方通行の道路で路肩や舗装色、縁石形状から進行方向を理解する

・自転車(バイク)レーンで実線と破線の切り替わりを見て、どこで進入・横断してよいかを判断する

・路上の植物やゴミ、障害物を避けるために少しラインを修正する

・無標示区間でも道路形状や周囲車両の動きから「どこを走るべきか」を推定する

といった具合である。

※カリフォルニアの自転車レーンは日本と大きく異なる。車道の右側に専用レーンとして明確に分離していて、白線・緑塗装・バッファ(緩衝帯)で表現される。また、最右から自動車の右折レーン、自転車レーン、直進レーンという構造の道路もある。

特に面白いのは、車線だけを頼りにしていない点だ。担当者は、日本のように多車線で複雑な道路でも、路面標示だけでなく、周囲の車両がどのような速度で、どういう並び方をしているかを見ることで、「ここには8本くらいのレーンがある」といった推定ができると説明した。さらに、地面の矢印、案内表示、標識などをカメラで読み取り、そこに他車の動きという“動的な文脈”を重ねることで、自車がどこにいて、どこへ行けるのかを理解しているという。これは、道路インフラを静的に地図化して頼るのではなく、その瞬間の道路世界を車両自身が再構成する考え方に近い。

Waymo・Teslaとどこがどう違うのか

Waymo(Googleアルファベット)やTeslaとの自動運転の違いについても聞いた。

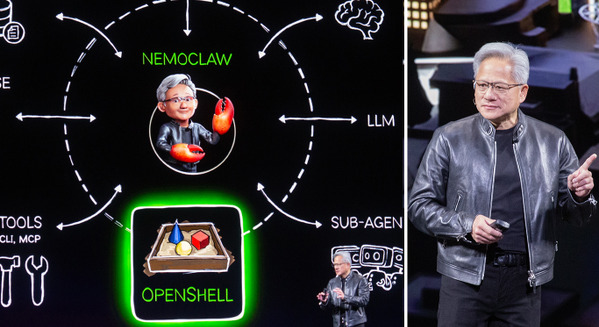

NVIDIAは、自動運転には大きく分けて3つの方式があるという整理を示した。

まずWaymo型は、レベル4のロボタクシーとしてLiDARを多数搭載し、さらにHDマップを活用するアプローチである。「HDマップ」を使うことで、「ここは右折専用レーンで幅は何メートル」「ここは自転車レーン」など、道路構造をきわめて詳細に事前把握できる。そのぶん、認識すべき世界がある程度整理され、冗長性も高い。タクシーやバスのように、特定エリア内で高精度な無人運転を目指すには非常に合理的な設計である。

■参考: Waymoの自動運転タクシー(無人)、LAやサンフランシスコ等で多く見られる

一方のTesla型は、基本的にカメラ中心で世界を理解しようとする。HDマップやLiDARへの依存を抑え、できるだけ広く一般化可能な知能で運転しようという思想が強い。エンドツーエンド学習の色合いも濃く、入力から出力までを統合的に最適化しようとする点が特徴だ。

これに対し、今回のNVIDIA/メルセデスのAlpamayoは、その中間で、用途別に最適化された柔軟なスタックだとの説明を受けた。

将来のロードマップ

今回のプロダクトはレベル2向けなので、カメラ+レーダーで成立させている。ここではドライバーが関与する前提があるため、このセンサー構成で十分な安全性と実用性を狙う。搭載しているGPUは「Orin」1基だけだ。

将来の「レベル4」仕様ではLiDARを加えて、360度の冗長性を持たせる方針だという。その際はGPUに最新の「Thor」を2基搭載する考えもあるという。

つまりNVIDIAは「カメラだけが正しい」(テスラ)、「HDマップが必須」(ウェイモ)というどちらかの手法に寄るのではなく、レベル2、レベル4、量産車、ロボタクシーといった目的に応じて、センサー構成とソフトウェア構成を変えられる立場を取っている。

加えてNVIDIAは、自社の役割を完成車メーカーではなく、自動運転エコシステムを支えるプラットフォーム提供者として位置づけていた。GPUによる学習計算基盤、シミュレーション、そして自社ソフトウェアスタックを持ち、パートナーはその一部だけを採用することも全部使うこともできる。Waymoのような企業がNVIDIAのGPUでモデル学習を行うこともあり得るし、メルセデスのようにNVIDIAソフトウェアを量産車に載せることもできる。カメラサプライヤーなども、NVIDIAの仕様に合っていれば柔軟に選べるという説明だった。この点は、単独で勝つよりも、業界全体の基盤を握るNVIDIAらしい考え方といえる。

未知の街、初めてのルートも自動運転できるのか

また、未知の環境での走行についても質問したところ、担当者は、AlpamayoはHDマップに依存しないため、事前に学習していない都市や道路でも走行可能だと説明した。

カメラやレーダーから得られる情報をもとに、車線、標識、周囲車両の動き、路面の表示などを総合的に理解し、その場で走行判断を行うためだ。

さらに、最近のモデルでは「reasoning(与えられた情報から、状況を理解し、次に何が起きるかを推測して行動を決める能力)」が強化されており、見たことのない状況でも、過去の類似ケースや文脈から適切な行動を推定できるという。これは単なるパターン認識ではなく、「原因と結果の関係を踏まえて行動を選択する」能力であり、自動運転AIの次の進化レベルといえる。

一方で、複雑な都市環境や交通ルールの違いなどに対しては、継続的な学習やデータの蓄積が重要であり、完全に未知の環境でも常に最適に走行できる段階にあるわけではないとした。こうした汎用性はまだ発展途上であり、実運用ではデータの蓄積と継続的な改善が不可欠である点も強調された。

ソフトウェア構成としては、担当者はエンドツーエンドモデルとクラシカルスタックを並列に動かしていると説明した。ここが重要で、純粋なエンドツーエンド一本ではなく、従来型のルールベースや幾何ベースの安全処理も併走させながら安全運転を実現しているようだ。つまり、学習ベースの柔軟さと、古典的な安全性の両方を活かす構成である。これはWaymo型とTesla型の“間”というより、両者の長所を取り込もうとする現実解に見える。

また、前述の「reasoning」も強調されていた。担当者によると、最近のAlpamayoは、過去データの模倣だけではなく、見たことのない場面でも推論して対処する能力が伸びてきたという。たとえば未知の挙動をする車がいても、「今までの似た状況」から相手の意図を推定し、どう行動すべきかを考える。これは単なるパターン一致から一歩進み、状況理解と行動予測を伴う自動運転AIへ進化しつつあることを示唆している。

NVIDIAは特定のアプローチに依存せず、用途に応じて構成を変えられる“プラットフォーム型”の立場を取っている点が特徴だ。

実装面では、今回の試乗車は市販のメルセデス車両に新しいソフトウェアを載せたもので、ハードウェア自体は量産仕様だ。ユーザーがその車を購入し、将来的にOTAアップデートで機能を受け取る形も想定されている。ここからは、研究デモではなく、量産実装を強く意識した開発であることが分かる。さらに、今回のレベル2デモでは、前述の通り、単一のNVIDIA Orin上で、エンドツーエンドモデル(E2E)とクラシカルスタック(ルールベースで安全基準を遵守)の両方を動かしていると説明された。これはかなり実用志向のメッセージであり、将来のレベル4ではThorを2基使う構成も見込んでいて、アップグレードによる進化も好感を持てた。

日本での展開について

最後に、日本展開についても聞いた。担当者は東京でのテスト計画に触れ、日本の多車線道路や複雑な分岐、左側通行、高速道路の料金体系などが難所になりうると認めつつも、車線だけでなく他車の動きや道路表示から文脈を理解する今の方式なら、十分に対応可能性があるとの見方を示した。全体を通じて、今回のAlpamayoは、地図に頼り切るのでも、カメラ一本に賭けるのでもなく、量産車に載る現実的な構成で“文脈理解しながら安全に走ることを狙った自動運転スタックとして説明した。

試乗した所感

実際に同乗してまず感じたのは、「特別なことをしている感じがしない」すなわち自然な運転だった。

交差点での停止や発進、右左折、車線変更といった一連の動作は滑らかで、通常の運転時では急な加減速や不自然な挙動はほとんど見られない。むしろ、人間の慎重なドライバーに近い印象だ。一方で急に割り込んできた他車との接触を避けるために避けながら急制動をかける場面があったが、その判断は正しく、人間の熟練ドライバーでもその方法で回避しただろう。

また、特に印象的だったのは、見通しの悪い場面での挙動である。駐車車両などで左右の確認が難しい交差点では、一度完全停止したあと、少しずつ前に出て視界を確保しながら判断する。いわゆる“クリープ”動作だが、その動きは過度に慎重すぎるわけでもなく、かといって強引でもない。カリフォルニアでは特定の交差点で右折する場合、赤信号に従わなくてもよい。左からひっきりなしに来る他車を確認しながら、少しずつ前に出て合流する様子が見られた。周囲の状況をうかがいながら、適切なタイミングで合流する様子は、運転中の人間の動きに非常に近いと感じた。

また、歩行者や周囲車両への反応も興味深い。道路脇に立っている人がわずかに動いただけでも減速するなど、「存在」だけでなく「これからどう動くか」を前提にした運転が行われていることが分かる。単なる物体認識ではなく、状況理解に基づいた判断が働いている印象だ。

さらに、消えかけた車線や複雑なレーン構成、複数の信号が並ぶ交差点といった、人間でも一瞬迷うような場面でも、大きく挙動を乱すことはなかった。完全に完璧というよりは、「迷いながらも安全側に寄せて判断する」ような振る舞いであり、その意味では“考えている”様子が伝わってくる。

全体として、今回の走行は派手さよりも「安定性」と「納得感」を重視したチューニングに感じられた。担当者が「スムーズで快適な運転」を目指したと語っていたが、その狙いは確かに体感できるものだった。

興味深いのは、こうした挙動が、現在進みつつあるヒューマノイドロボットの開発とも重なる点だ。

自動運転もヒューマノイドも、本質的には「現実世界の状況を理解し、適切な行動を選択する」という同じ問題に向き合っている。

今回の走行で見られたように、見通しの悪い交差点で少しずつ前に出て確認する、歩行者の動きを予測して減速する、曖昧な車線や環境から進路を推定する、といった挙動は、あらかじめ決められたルールだけでは成立しない。周囲の状況を解釈し、「次に何が起きるか」を推測しながら行動する必要がある。

ヒューマノイドへの展開

ヒト型ロボットと自動運転の技術はまったく違うと思う読者は多いかもしれないが、それは間違いであり、NVIDIAやTeslaは同じフィジカルAIと捉えている。自動運転の技術はまさにヒューマノイドが現実世界で作業する際に求められる能力と同じだ。物体を認識するだけでなく、その物体がどう動くか、環境がどう変化するかを理解し、予想しながら行動する。

NVIDIAが推進する「フィジカルAI」は、こうした共通の課題に対する統合的なアプローチといえる。自動運転で培われた認識・予測・意思決定の技術は、ヒューマノイドにも応用され、逆にロボティクスの知見も自動運転へとフィードバックされていく。

今回のAlpamayoの走行は、単に自動運転の進化とみるより、「現実世界で動くAI」の共通基盤が形になり始めたことを示している。

最後にNVIDIAが公式に投稿しているAlpamayoのリーズニングに関する動画をこの記事でも紹介しておこう。