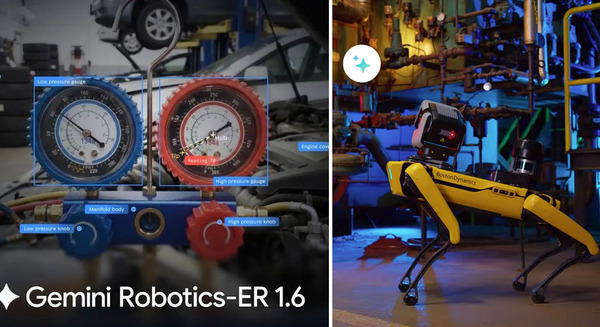

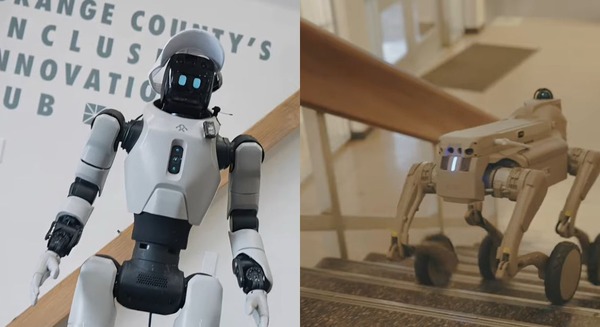

Google DeepMindは2025年3月13日、Googleの最新の生成AI「Gemini 2.0」をロボット分野で活用する「Gemini Robotics」を発表した。これをヒューマノイドに応用した動画「Gemini Robotics: Bringing AI to the physical world」は別の記事で紹介した。

今回の記事では、同日にYouTube公開された「Gemini Robotics: Bringing AI to the physical world」に沿って、Google DeepMindが「Gemini Robotics」で重点的に研究開発している3つのポイントについて解説したい。

人との会話から指示とその意図を理解

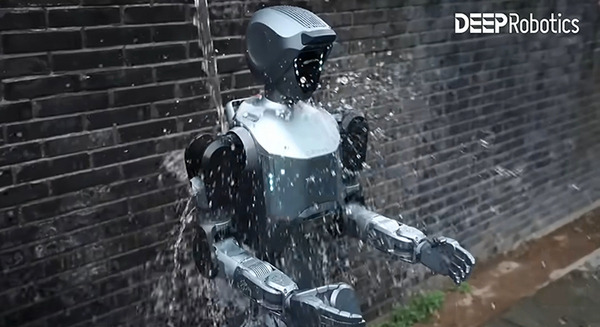

この動画のナレーションは「Google DeepMindは最新技術の生成AI「Gemini 2.0」の知能を、物理世界(リアル社会)の汎用ロボットエージェントに取り入れています」という内容から始まっている。前回の動画では、ロボットベンチャーのApptronik社と提携して、ロボットはヒト型ロボット「ヒューマノイド」を使っている。ヒューマノイドは会話によって人との意思疎通をはかり、ゲームのルールや手伝う内容を「Gemini」の情報から収集して動作している。

ただ、ヒューマノイドを含めて、汎用ロボットに必要なスキルのひとつに、ロボットハンド(手)を正確に制御し、瞬く間に変化する状況にも対応して、指示されたことを正確に成し遂げること、があげられる。

「Gemini Robotics」が重視している3つのポイント

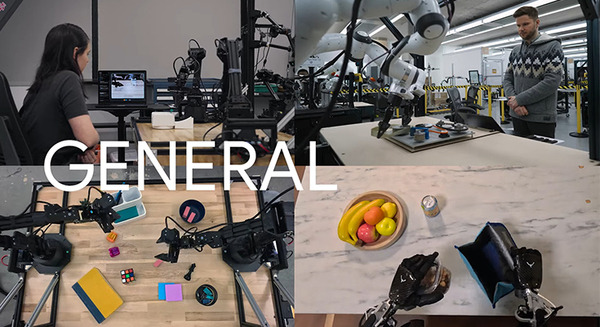

この動画でGoogle DeepMindは「ロボットが役に立つためには3つの性能が重要」としている。その3つの能力とは、インタラクティブ性、器用さ、汎用性だ。

そばで指示している人の行動や声に、ロボットはリアルタイムに、かつ高精度に応答して動作しなければならない。そして、ロボットが複雑な作業をこなすため高精度に動くためには、3次元でリアル世界を理解し、モノの位置や移動を把握することも重要だ。

「Gemini Robotics」はこれらの能力を、ヒューマノイドだけでなく、さまざまな形状の物理的ロボットで機能させることを目指し、ビジョン・言語・アクションモデルを開発している。まずは動画を見てもらい、その後で解説に入りたい。

■Gemini Robotics: Bringing AI to the physical world

インタラクティブ性

「Gemini」は最新の生成AIで、意図を含めて人の会話を高精度に理解することができる。人がAIロボットに対して「バナナを透明な容器に入れてください」と指示をすると、ロボットはそれに従って動作をはじめる。ロボットは机の上の2本のバナナのうち、まず1本をつかんで、透明な容器に入れる。

次のバナナをロボットが入れようとしたとき、人が透明な容器を移動させる。ロボットはそれに混乱することなく、透明な容器の移動した場所を再度把握して(再計画して)、透明な容器の中にバナナを入れた。

同じく、人が「ぶどうを透明な容器に入れてください」と指示すると、同様に容器を動かされても、即座に再計画して対応している。

研究中のこのAIモデルは、ロボットとリアルタイムで協力できるあらゆる用途に適用できる。

高い器用さ(Dexterous)

ロボット工学において高精度な作業は最大の課題のひとつ。

AIロボットは「オレンジ色の紙を折って折り紙のキツネを作れます」と宣言、人が「面白そうだね。やってみよう」と呼びかけると、オリガミでキツネを折り始める。

AIロボットは「折り紙(origami)」という言葉の由来は、日本語の「折る(ori)」と「紙(kami)」から来ていることをを知っていますか」と話す。この情報は、Gemini 2.0のデータベースから取得した情報であり、紙を折るという高精度な動作は、高度な空間認識によって実現されている。ロボットは「キツネの目はここですね」と言ってディスプレイ上に表示してオリガミを仕上げた。

汎用性

「Gemini 2.0」が様々な項目において理解を示し、現実世界の多種多様な作業に対応するためには「汎用性」が重要になる。

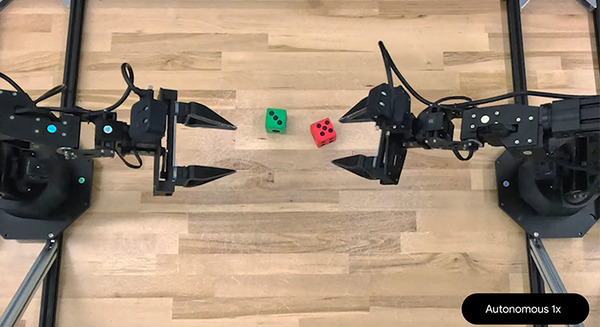

人がAIロボットに「赤いサイコロをひっくり返して、緑のサイコロと同じ数字にしてください」と指示をする。

多くのロボットはあらかじめ決められた動作は正確に実行できるものの、従来のロボットは事前にプログラミングされていないことを考えてこなすのは難しかった。

しかし、「Gemini Robotics」のAIロボットは、その時点で見えているものと、指示通りにおこなうには、自身がどう動くべきか、もうひとつのロボットハンドとどう協調するべきかを推論して、指示された目的を達成しようとする。

その結果、赤いサイコロの目を、人が指示した通りに緑のサイコロと同じ数字に合わせることができた。

バスケットボールを持って、ダンクシュートを決めて下さい

動画では、汎用性を拡げるもうひとつの例を紹介している。このAIモデルは訓練されたことのないタスクにも適応できることを示すものだ。

人「バスケットボールを持って、ダンクシュートを決めて下さい」。AIロボットはバスケットボール(の玩具)を見たことがなかったものの、Gemini 2.0は「バスケットボール」や「ダンクシュート」といった概念を大規模言語モデルのデータを参照して自律的に理解することで、タスクを実行することができたことが示されている。

「Gemini Robotics」では、より多くのパートナーを「Trusted Testers Program」に招待し、次世代のロボットAIエージェントの開発を進めていくという。

Geminiを物理世界に導入する詳細については、deepmind.google/robotics を参照のこと。

Google DeepMindが生成AI「Gemini」をヒューマノイドで活用 会話・三目並べ・文字パズルの動画を公開 Apptronikと連携

Lumosがヒューマノイドと触覚センサーの動画公開 丘を走り、壊れものを掴む、打ち上げ花火を手持ちでぶっぱなす様子も

ボストン・ダイナミクスのヒューマノイド「電動アトラス」自動車製造工場で働くためトレーニング中!ラボ内部の動画を公開

家庭用から宇宙まで!? インドのMuksがヒューマノイドを近々リリースすると発表

UBTECH、複数台のヒューマノイドがEVメーカー「Zeekr」のスマート工場で働く動画を公開 Zeekrは2025年に日本市場へ参入予定

Unitreeのヒューマノイド、今度はスピンキックを披露!「720°スピンキック、衝撃を聞け!」

触覚を持ったヒューマノイドの動画をSanctuary AIが公開 視覚で手を伸ばし触覚でつかむ 手探り「ブラインドピッキング」も披露

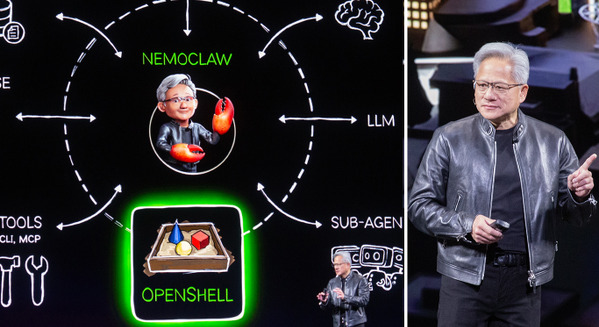

NVIDIA ヒューマノイド開発支援の最新情報 「Boston DynamicsやFigureなどの大手ロボット企業が導入」

ヒューマノイドロボットが物流現場で働く未来像? Figureがパッケージを認識・選別する動画を公開 OpenAIやMicrosoft、NVIDIAなどが出資

ヒューマノイド関連記事(ロボスタ)